Last updated: 2026/04/26 13:01

Learn what's new in Visual Studio Code 1.118 (Insiders)

Organize your home and digital space with Gemini. Use AI-powered tips for cleaning schedules, inbox decluttering, seasonal chores.

In this post, we show how connecting the Visier Workforce AI platform with Amazon Quick through Model Context Protocol (MCP) gives every knowledge worker a unified agentic workspace to ask questions in. Visier helps ground the workspace in live workforce data and the organizational context that surrounds it while letting your users act on the conversational results without switching tools.

You can now access GPT 5.5 and GPT 5.5 Pro on Vercel's AI Gateway with no markup and no other provider accounts required.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

Your Mastra agents can now browse and take actions on the web, just like you can.

Building cloud agents is difficult. We share some learnings from building Devin.

Cricket Australia Live app brings the game closer to fans with Microsoft AI powered rich insights

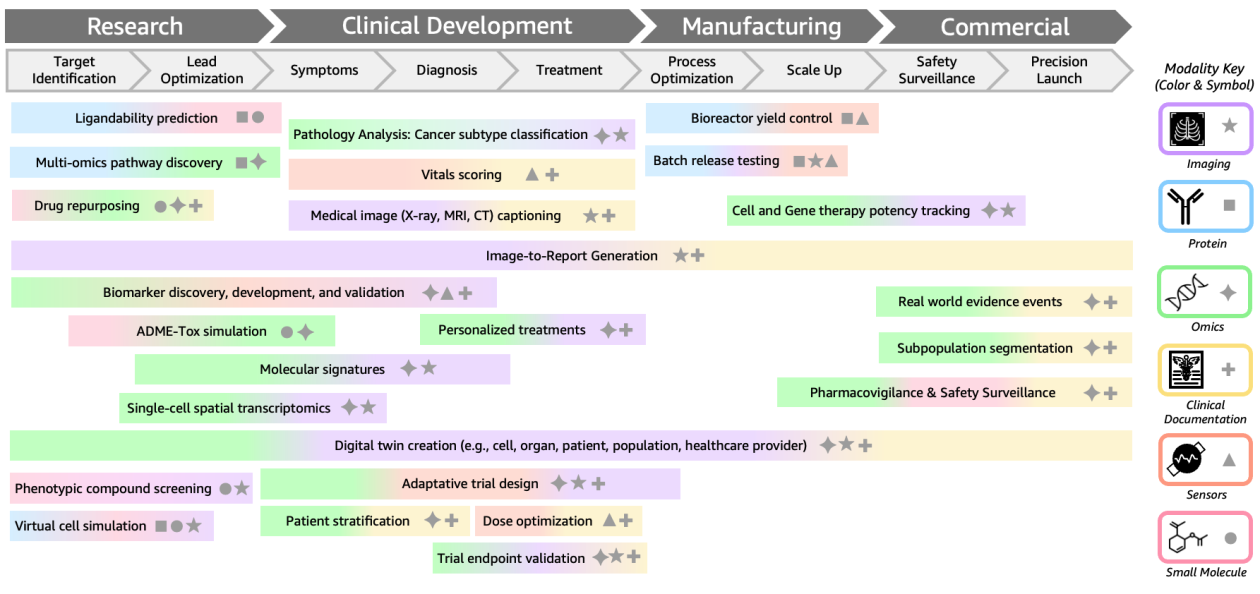

In this post, we'll explore how multimodal BioFMs work, showcase real-world applications in drug discovery and clinical development, and contextualize how AWS enables organizations to build and deploy multimodal BioFMs.

Learn how Google’s TPUs power increasingly demanding AI workloads with this new video.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されており、導入のハードルが低い点も特徴です。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的なユーザーインターフェースで導入が容易

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に自然言語処理を用いた機能が強化されています。具体的には、開発者が自然言語で指示を出すと、AIがそれに基づいてコードを生成することが可能です。また、ツールは既存の開発環境に簡単に統合できるよう設計されており、ユーザーは特別な設定を行うことなくすぐに利用を開始できます。さらに、AIによるコード生成は、開発の効率を大幅に向上させることが期待されています。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での指示に基づいてコードを生成する機能 • 既存の開発環境への簡単な統合 • 開発効率の向上が期待される • 自然言語処理を用いた強化された機能

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が入力した要件に基づいて、AIが最適なコードを提案し、開発の効率を向上させることを目的としています。また、ツールの導入により、開発時間の短縮やエラーの減少が期待されると述べられています。さらに、ユーザーインターフェースも直感的で使いやすく設計されており、幅広い開発者に対応できるようになっています。 • AI技術を活用した新しい開発ツールの紹介 • 生成AIを利用してコードの自動生成や修正を行う • 開発者が入力した要件に基づいて最適なコードを提案 • 開発時間の短縮やエラーの減少が期待される • 直感的で使いやすいユーザーインターフェースを提供

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部に基づいて、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやTypeScriptプロジェクトでの使用が推奨 • 既存の開発環境に簡単に統合可能 • 開発効率の向上とエラー削減が期待される

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されています。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した内容に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的で使いやすいユーザーインターフェース

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発者は効率的に作業を進めることができ、エラーの削減や生産性の向上が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発者の生産性向上とエラー削減の期待 • 多くのプログラミング言語に対応

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案する機能 • JavaScriptやTypeScriptプロジェクトへの統合が容易 • 開発効率の向上とエラー削減が期待される

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特にJavaScriptやTypeScriptのプロジェクトにおいて効果を発揮します。具体的には、コードの自動生成やエラーチェック、最適化提案などの機能があり、開発の効率を大幅に向上させることが期待されています。また、ユーザーインターフェースも直感的で使いやすく設計されており、導入のハードルが低い点も特徴です。さらに、クラウドベースでの運用が可能で、チームでの共同作業を円滑にするための機能も備えています。 • AI技術を活用した新しい開発ツールの紹介 • JavaScriptやTypeScriptプロジェクトに特化した機能 • コードの自動生成、エラーチェック、最適化提案が可能 • 開発効率を大幅に向上させることが期待される • 直感的で使いやすいユーザーインターフェース • クラウドベースでの運用が可能 • チームでの共同作業を円滑にする機能を備えている

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやTypeScriptプロジェクトでの使用が推奨 • 既存の開発環境に簡単に統合可能 • 開発効率の向上とエラー削減が期待される

Google has been a proud part of Austria’s landscape for years, and today, we’re announcing our first data center in Kronstorf, generating 100 direct jobs. This facility …

You can now access Deepseek V4 on Vercel's AI Gateway with no markup and no other provider accounts required.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広いプロジェクトで利用可能です。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での入力に基づくコードの自動生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の期待 • 多くのプログラミング言語に対応

Multi-agent AI systems fail silently. Learn what proper observability looks like when agents orchestrate agents, and how Sentry keeps you in control.

In this post, we walk through building a scalable, event-driven transcription pipeline that automatically processes audio files uploaded to Amazon Simple Storage Service (Amazon S3), and show you how to use Amazon EC2 Spot Instances and buffered streaming inference to further reduce costs.

Today, Amazon SageMaker AI supports optimized generative AI inference recommendations. By delivering validated, optimal deployment configurations with performance metrics, Amazon SageMaker AI keeps your model developers focused on building accurate models, not managing infrastructure.

Today, we're introducing new capabilities that further streamline the agent building experience, removing the infrastructure barriers that slow teams down at every stage of agent development from the first prototype through production deployment.

10 months ago I argued against building multi-agent systems. Today, a narrower class works, where agents contribute intelligence while writes stay single-threaded. I want to share what we've learned building them at Cognition.

この記事では、Google Photosの新機能「Auto frame」について説明しています。この機能は、撮影後に写真の視点を再構成する新しいアプローチを提供します。従来の画像編集ツールでは解決できない、固定された視点からの問題を解決するために、機械学習と生成AIを活用しています。具体的には、2Dの写真を3Dシーンとして解釈し、カメラの位置を自動的に変更することで、新しい視点を提供します。このプロセスは、3Dシーンとカメラの推定、生成的なインペインティングとレタッチの2段階から成り立っています。最初の段階では、3Dポイントマップを用いて人間の体や顔を忠実に再構築し、次に古いカメラパラメータを用いて画像を生成します。最終的に、生成モデルを使用して、元のレンズでは捉えられなかった背景部分を補完します。 • Google Photosの新機能「Auto frame」により、撮影後に写真の視点を再構成できる。 • 機械学習と生成AIを使用して、固定された視点の問題を解決する。 • 2D写真を3Dシーンとして解釈し、カメラの位置を自動的に変更する。 • プロセスは3Dシーンとカメラの推定、生成的なインペインティングの2段階から成る。 • 3Dポイントマップを用いて人間の体や顔を忠実に再構築し、画像を生成する。 • 生成モデルを使用して、元のレンズでは捉えられなかった部分を補完する。

Company-wise memory in Amazon Bedrock, powered by Amazon Neptune and Mem0, provides AI agents with persistent, company-specific context—enabling them to learn, adapt, and respond intelligently across multiple interactions. TrendMicro, one of the largest antivirus software companies in the world, developed the Trend’s Companion chatbot, so their customers can explore information through natural, conversational interactions

A Blog post by NVIDIA on Hugging Face

OpenAI makes ChatGPT for Clinicians free for verified U.S. physicians, nurse practitioners, and pharmacists, supporting clinical care, documentation, and research.

The eighth generation of Google’s TPU includes two specialized chips that will power the future of AI.

Google’s new distributed architecture keeps AI training runs on track across distant data centers, with exceptional efficiency – even when hardware fails.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。これにより、開発者はコーディングの効率を大幅に向上させることができ、エラーの削減や開発時間の短縮が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した情報に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • コーディング効率の向上が期待される • エラー削減や開発時間短縮のメリット

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が大幅に向上し、エラーの削減にも寄与します。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の効果 • 多言語対応で幅広い開発環境に適応

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の期待 • 多くのプログラミング言語に対応

A 7-step playbook for scoping, building, and shipping AI agent prototypes.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が大幅に向上し、エラーの削減にも寄与します。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の効果 • 多言語対応で幅広い開発環境に適応

What enterprises underestimate about building cloud agents.

Today, we're excited to announce Claude Cowork in Amazon Bedrock. You can now run Cowork and Claude Code Desktop through Amazon Bedrock, directly or using an LLM gateway. In this post, we walk through how Claude Cowork integrates with Amazon Bedrock and show an example of how knowledge workers use it in practice.

Evaluate AI agents effectively: learn offline vs. online testing, key metrics, and methods like deterministic checks, LLM-as-a-judge, and human review to improve performance and reliability.

In this post, we show how to combine DVC (Data Version Control), Amazon SageMaker AI, and Amazon SageMaker AI MLflow Apps to build end-to-end ML model lineage. We walk through two deployable patterns — dataset-level lineage and record-level lineage — that you can run in your own AWS account using the companion notebooks.

ReasoningBankは、エージェントが成功と失敗の経験から一般化可能な推論戦略を抽出し、デプロイ後も継続的に学習できるようにする新しいエージェントメモリフレームワークです。従来のエージェントは、メモリ機構なしで新しいタスクに取り組むと、同じ戦略的エラーを繰り返し、貴重な洞察を失ってしまいます。ReasoningBankは、成功体験と失敗体験の両方から有用な洞察を抽出し、テスト時の自己進化を可能にします。具体的には、エージェントはReasoningBankから関連するメモリを引き出し、環境と相互作用し、得られた結果を自己評価します。このプロセスにより、エージェントは成功の洞察や失敗の反省を抽出し、戦略的なガードレールを構築します。ReasoningBankは、ウェブブラウジングやソフトウェアエンジニアリングのベンチマークで評価され、エージェントの効果と効率を向上させることが確認されています。 • エージェントが成功と失敗の経験から学ぶことができないという課題を解決する。 • ReasoningBankは、成功体験と失敗体験の両方から洞察を抽出する新しいメモリフレームワークを提案。 • エージェントは、ReasoningBankからメモリを引き出し、環境と相互作用し、結果を自己評価する。 • 失敗からの教訓を抽出し、戦略的ガードレールを構築することで、エージェントの効果と効率を向上させる。 • ReasoningBankは、ウェブブラウジングやソフトウェアエンジニアリングのベンチマークで高い成功率と効率を示す。

Google DeepMind is partnering with leading consultancies to bridge the AI adoption gap and drive agentic transformation with frontier models and expert research.

A Blog post by Technology Innovation Institute on Hugging Face

You can now access GPT Image 2 on Vercel's AI Gateway with no markup and no other provider accounts required.

A Blog post by NVIDIA on Hugging Face

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されています。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した内容に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的で使いやすいユーザーインターフェース

Today, we are thrilled to announce the availability of G7e instances powered by NVIDIA RTX PRO 6000 Blackwell Server Edition GPUs on Amazon SageMaker AI. You can provision nodes with 1, 2, 4, and 8 RTX PRO 6000 GPU instances, with each GPU providing 96 GB of GDDR7 memory. This launch provides the capability to use a single-node GPU, G7e.2xlarge instance to host powerful open source foundation models (FMs) like GPT-OSS-120B, Nemotron-3-Super-120B-A12B (NVFP4 variant), and Qwen3.5-35B-A3B, offering organizations a cost-effective and high-performing option.

You can use ToolSimulator, an LLM-powered tool simulation framework within Strands Evals, to thoroughly and safely test AI agents that rely on external tools, at scale. Instead of risking live API calls that expose personally identifiable information (PII), trigger unintended actions, or settling for static mocks that break with multi-turn workflows, you can use ToolSimulator's large language model (LLM)-powered simulations to validate your agents. Available today as part of the Strands Evals Software Development Kit (SDK), ToolSimulator helps you catch integration bugs early, test edge cases comprehensively, and ship production-ready agents with confidence.

In this post, we'll show you how to build a complete omnichannel ordering system using Amazon Bedrock AgentCore, an agentic platform, to build, deploy, and operate highly effective AI agents securely at scale using any framework and foundation model and Amazon Nova 2 Sonic.

You can now access Moonshot AI's Kimi K2.6 on Vercel's AI Gateway with no markup and no other provider accounts required.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコードの意図を理解し、適切なコードスニペットを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。さらに、ユーザーからのフィードバックを基に継続的に改善される点も強調されています。 • AI技術を活用した新しい開発ツールの紹介 • コードの自動生成や補完機能を提供 • 開発者の意図を理解して適切なコードを提案 • 多くのプログラミング言語に対応、特にJavaScriptとPythonが推奨 • ユーザーからのフィードバックを基に継続的に改善される

In this post, we share how Amazon Bedrock's granular cost attribution works and walk through example cost tracking scenarios.

In this post, we show you how to use Model Distillation, a model customization technique on Amazon Bedrock, to transfer routing intelligence from a large teacher model (Amazon Nova Premier) into a much smaller student model (Amazon Nova Micro). This approach cuts inference cost by over 95% and reduces latency by 50% while maintaining the nuanced routing quality that the task demands.

In this post, we show you how to build a video semantic search solution on Amazon Bedrock using Nova Multimodal Embeddings that intelligently understands user intent and retrieves accurate video results across all signal types simultaneously. We also share a reference implementation you can deploy and explore with your own content.

This hands-on guide walks through every step of fine-tuning an Amazon Nova model with the Amazon Nova Forge SDK, from data preparation to training with data mixing to evaluation, giving you a repeatable playbook you can adapt to your own use case. This is the second part in our Nova Forge SDK series, building on the SDK introduction and first part, which covered kicking off customization experiments.

In this post, we share how AWS Marketing’s Technology, AI, and Analytics (TAA) team worked with Gradial to build an agentic AI solution on Amazon Bedrock for accelerating content publishing workflows.

A Blog post by NVIDIA on Hugging Face

この記事では、Metaが内部の推薦およびランキング作業における効果的なトレーニング時間(ETT%)を最適化する方法について説明しています。ETT%は、全体のエンドツーエンド(E2E)時間の中で生産的なトレーニングに費やされる時間の割合を示し、効率性の向上に向けた優先順位付けを助けます。Metaは、PyTorchを使用してモデルをトレーニングする際の経験に基づき、オープンソースで実装された改善策(TorchRecのシャーディング計画やPyTorch 2のコンパイル最適化など)と、Meta特有の改善策(チェックポイントやモデルの公開など)を共有しています。ETT%の向上を目指し、過去数年間で40以上の新技術を開発し、トレーニングの開始時間を短縮するための取り組みを行っています。 • Metaは効果的なトレーニング時間(ETT%)を定義し、全体のE2E時間の中で生産的なトレーニングに費やされる時間の割合を示す。 • ETT%を向上させるために、システムの最適化視点からアイダレスや失敗を測定することに焦点を当てている。 • トレーニングサイクルの各段階(スケジューリング時間、ハードウェアセットアップ時間、PT2コンパイル時間など)を定義し、改善のための指標を提供している。 • Metaは40以上の新技術を開発し、ETT%の向上に向けた取り組みを行っている。 • オープンソースでの改善策とMeta特有の改善策を共有し、業界全体のボトルネックに対処する。

A Blog post by NVIDIA on Hugging Face

See how Zo Computer used Vercel AI Gateway and AI SDK to cut retry rates 20x, raise chat success to 99.93%, reduce P99 latency by 38%, and add new model support in under a minute while scaling its personal AI cloud platform.

In this post, we demonstrate two approaches to fine-tune Amazon Nova Micro for custom SQL dialect generation to deliver both cost efficiency and production ready performance.

Online retailers face a persistent challenge: shoppers struggle to determine the fit and look when ordering online, leading to increased returns and decreased purchase confidence. The cost? Lost revenue, operational overhead, and customer frustration. Meanwhile, consumers increasingly expect immersive, interactive shopping experiences that bridge the gap between online and in-store retail. Retailers implementing virtual try-on […]

In this post, you'll learn why probabilistic AI validation falls short in regulated industries and how Automated Reasoning checks use formal verification to deliver mathematically proven results. You'll also see how customers across six industries use this technology to produce formally verified, auditable AI outputs, and how to get started.

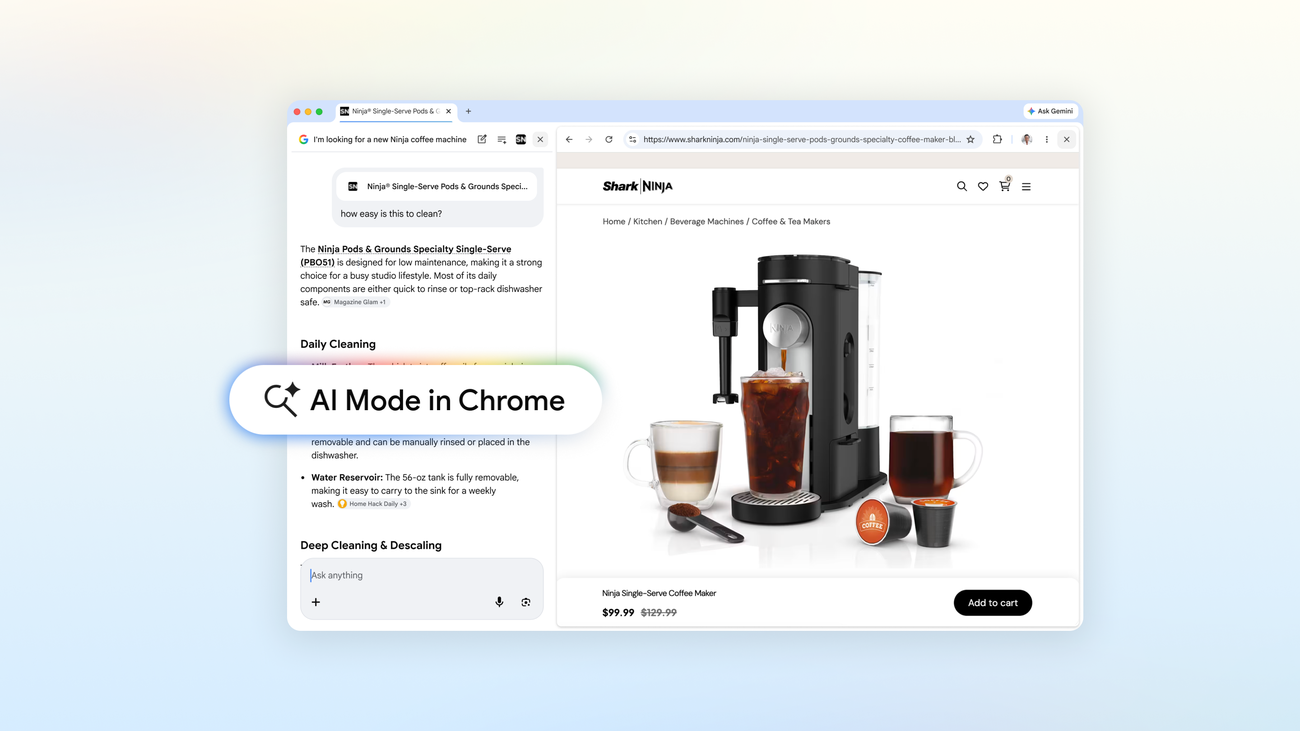

Today’s upgrades for AI Mode in Chrome transform how you interact with the web

Nano Banana 2 now uses your personal context and Google Photos to create images that reflect your unique life.

AI observability checklist for 2026: gain visibility, control AI agents, manage risks, and scale trusted enterprise AI.

この記事では、特化型AIに必要なデータの不足に対処するためのフレームワーク「Simula」を紹介しています。Simulaは、合成データ生成をデータセットレベルのメカニズム設計として再定義し、ファーストプリンシプルからデータセットを構築することで、カバレッジ、複雑さ、品質を細かく制御できるようにします。これにより、プライバシーに敏感な領域やデータが不足している領域において、スケーラブルなデータ生成が可能になります。従来の合成データ生成方法は、手動のプロンプトや進化的アルゴリズムに依存しており、スケーラビリティや説明可能性に制限がありました。Simulaは、データ生成プロセスを明確に制御可能な軸に分解し、グローバルな多様性を確保するための戦略を定義します。 • 特化型AIに必要なデータの不足に対処するためのフレームワーク「Simula」を提案 • Simulaは合成データ生成をデータセットレベルのメカニズム設計として再定義 • ファーストプリンシプルからデータセットを構築し、カバレッジ、複雑さ、品質を制御可能 • 従来の合成データ生成方法は手動プロンプトや進化的アルゴリズムに依存し、スケーラビリティに制限があった • Simulaはデータ生成プロセスを明確に制御可能な軸に分解し、グローバルな多様性を確保するための戦略を定義

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行うことができ、開発効率を大幅に向上させることが期待されています。さらに、このツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での入力に基づくコードの自動生成機能 • 既存コードへの改善提案機能 • 開発効率の向上が期待される • JavaScriptやPythonに特に対応している

You can now access Claude Opus 4.7 on Vercel's AI Gateway with no markup and no other provider accounts required.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者が効率的にコードを書くための支援を行い、特に生成AIを利用した機能が強調されています。具体的には、自然言語での指示を受けてコードを生成する能力や、既存のコードの改善提案を行う機能が含まれています。また、ユーザーインターフェースが直感的で使いやすく設計されており、開発者がすぐに利用できるようになっています。さらに、ツールの導入によって開発プロセスの効率が向上し、エラーの削減が期待できると述べられています。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での指示に基づくコード生成機能 • 既存コードの改善提案機能 • 直感的で使いやすいユーザーインターフェース • 開発プロセスの効率向上とエラー削減の期待

Multi-agent observability is exponentially harder than single-agent monitoring. Here's how to trace, debug, and monitor AI systems where agents orchestrate other agents.

Local agents make you faster. Cloud agents do the work while you're not there.

Gemini 3.1 Flash TTS is now available across Google products.

In this post, you will learn how speculative decoding works and why it helps reduce cost per generated token on AWS Trainium2.

This post is cowritten by Renata Salvador Grande, Gabriel Bueno and Paulo Laurentys at Rede Mater Dei de Saúde. The growing adoption of multi-agent AI systems is redefining critical operations in healthcare. In large hospital networks, where thousands of decisions directly impact cash flow, service delivery times, and the risk of claim denials, the ability […]

Gemini 3.1 Flash TTS is now available across Google products.

Explore how Microsoft is advancing Frontier Transformation across industries, helping organizations move from AI experimentation to real world impact.

A Blog post by IBM Research on Hugging Face

Ship more with local and cloud agents working together.

OpenAI updates the Agents SDK with native sandbox execution and a model-native harness, helping developers build secure, long-running agents across files and tools.

You can now access Seedance 2.0 Video Generation via Vercel's AI Gateway with no other provider accounts required.

The conversation about AI and coding work is full of highs. These models are incredible! I’m so productive. I’m not blocked by a lack of knowledge in certain areas like I used to get. I’m making projects I never would have gotten around to making. I’m having fun with code for the first time in […]

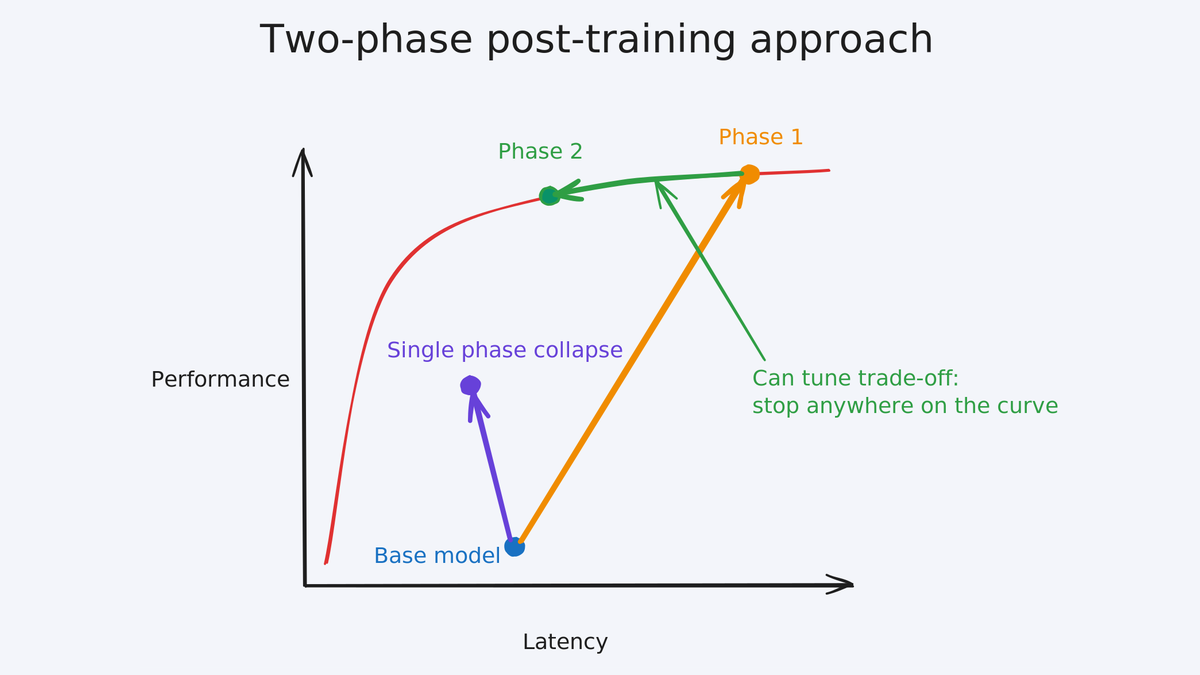

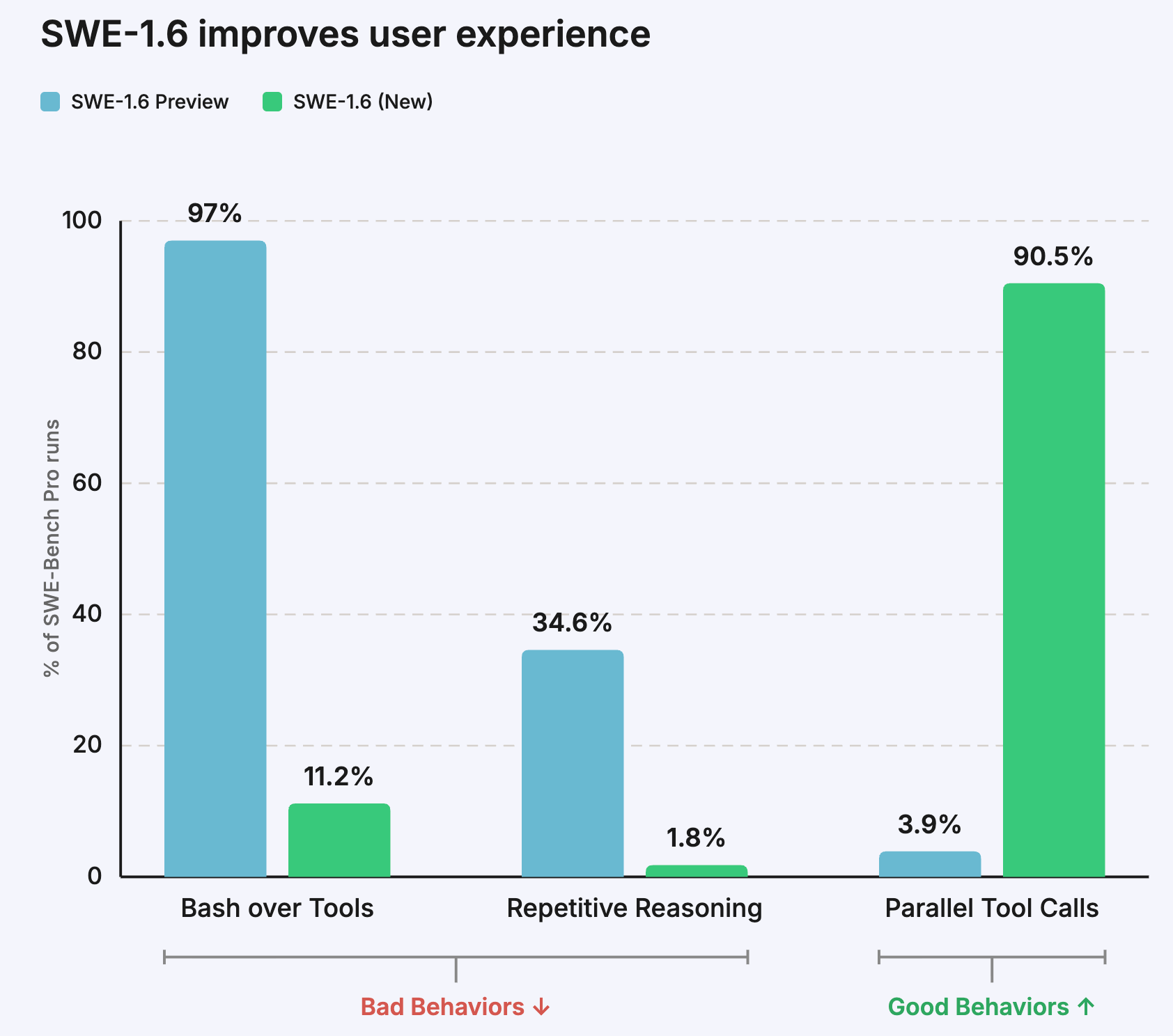

Smaller specialized models can match or beat frontier generalists on the tasks they're trained for. Working with Applied Compute, we RL-trained SWE-check, a bug detection model that matches Opus 4.6 on our internal evals while running ~10x faster.

In this post, we introduce the Generative AI Path-to-Value (P2V) framework, a structured approach to help you move generative AI initiatives from concept to production and sustained value creation.

We're excited to announce the launch of Amazon SageMaker JumpStart optimized deployments. SageMaker JumpStart improved deployments address the need for rich and straightforward deployment customization on SageMaker JumpStart by offering pre-defined deployment configurations, designed for specific use cases. Customers maintain the same level of visibility into the details of their proposed deployments, but now deployments are optimized for their specific use case and performance constraint.

This post explores how Amazon SageMaker HyperPod provides a comprehensive solution for inference workloads. We walk you through the platform’s key capabilities for dynamic scaling, simplified deployment, and intelligent resource management. By the end of this post, you’ll understand how to use the HyperPod automated infrastructure, cost optimization features, and performance enhancements to reduce your total cost of ownership by up to 40% while accelerating your generative AI deployments from concept to production.

In this post, we walk through how Guidesly built Jack AI on AWS using AWS Lambda, AWS Step Functions, Amazon Simple Storage Service (Amazon S3), Amazon Relational Database Service (Amazon RDS), Amazon SageMaker AI, and Amazon Bedrock to ingest trip media, enrich it with context, apply computer vision and generative AI, and publish marketing-ready content across multiple channels—securely, reliably, and at scale.

Skills in Chrome let you discover, save and remix AI workflows — and repeat them instantly.

With the new Spring AI AgentCore SDK, you can build production-ready AI agents and run them on the highly scalable AgentCore Runtime. The Spring AI AgentCore SDK is an open source library that brings Amazon Bedrock AgentCore capabilities into Spring AI. In this post, we build an AI agent starting with a chat endpoint, then adding streaming responses, conversation memory, and tools for web browsing and code execution.

この記事では、AIが生成した合成ニューロンの形状を用いて、脳のマッピングを迅速化する手法について説明しています。Google Researchの研究者たちは、合成ニューロンを利用してニューロンの分類精度を向上させ、脳の再構築を加速させることを目指しています。特に、果実バエの脳の完全なマップが作成され、166,000のニューロンが含まれていますが、哺乳類や人間の脳の完全な再構築はまだ遠い目標です。新しい論文「MoGen: Detailed neuronal morphology generation via point cloud flow matching」では、合成ニューロンを用いることで再構築誤差を4.4%削減できることが示されており、これはマウスの脳全体において157人年の手動校正を節約することに相当します。 • AIが生成した合成ニューロンを用いて脳のマッピングを迅速化する手法を提案 • 果実バエの脳マップは166,000のニューロンを含み、AIと人間の専門家による共同作業で作成された • 合成ニューロンを用いることで再構築誤差を4.4%削減できることが示された • この誤差削減は、マウスの脳全体で157人年の手動校正を節約することに相当する • Connectomicsの分野で、脳細胞の再構築を行い、脳の配線マップを作成するプロセスを加速させるためにAIを活用している

Google is bringing people together in Washington D.C. at our AI for the Economy Forum.

Over the next several weeks, we'll release lessons on AI evals.

OpenAI expands its Trusted Access for Cyber program, introducing GPT-5.4-Cyber to vetted defenders and strengthening safeguards as AI cybersecurity capabilities advance.

本研究は、生成AIを活用して「未来に備えた」スキルを評価する新しいアプローチを示しています。ニューヨーク大学との共同研究により、AIによる評価が人間の専門家と同等であることが確認されました。この研究実験「Vantage」は、Google Labsで利用可能です。AIの進化に伴い、批判的思考や協力、創造的思考などの持続可能な人間の能力がますます重要視されています。Vantageは、高校生や大学生がシミュレーション環境でスキルを練習し、評価を受けるためのサンドボックスを提供します。AIアバターとの動的な会話を通じて、学生は実世界に近いシナリオでスキルを示す機会を得ます。 • 生成AIを用いた未来に備えたスキルの評価方法を提案 • AI評価が人間の専門家と同等であることを確認 • Vantageは高校生や大学生向けのシミュレーション環境を提供 • AIアバターとの会話を通じてスキルを評価 • 動的な会話環境での実世界に近いシナリオを再現 • 評価基準に基づいてAIが会話を導く • 教育者が授業をスキルに合わせて調整できるよう支援

This post demonstrates how Lambda enables scalable, cost-effective reward functions for Amazon Nova customization. You'll learn to choose between Reinforcement Learning via Verifiable Rewards (RLVR) for objectively verifiable tasks and Reinforcement Learning via AI Feedback (RLAIF) for subjective evaluation, design multi-dimensional reward systems that help you prevent reward hacking, optimize Lambda functions for training scale, and monitor reward distributions with Amazon CloudWatch. Working code examples and deployment guidance are included to help you start experimenting.

Gemini Robotics ER 1.6 upgrades spatial reasoning and multi-view understanding, unlocking new capabilities like instrument reading for autonomous robots.

AI-powered tools are being used to bring greater efficiency and security to healthcare around the world and increase access to medicines and care.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されています。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的で使いやすいユーザーインターフェース

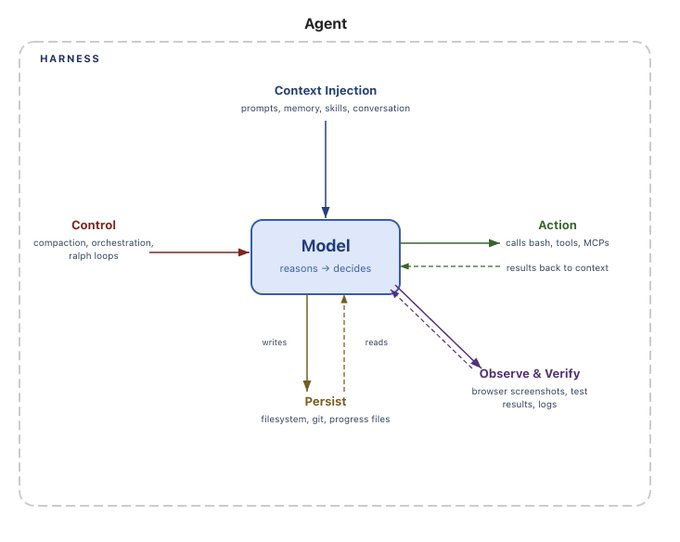

Agent harnesses are becoming the dominant way to build agents, and they are not going anywhere. These harnesses are intimately tied to agent memory. If you used a closed harness - especially if it’s behind a proprietary API - you are choosing to yield control of your agent’s

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやTypeScriptプロジェクトでの使用が推奨 • 既存の開発環境に簡単に統合可能 • 開発効率の向上とエラー削減が期待される

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者はコーディングの効率を大幅に向上させることができ、エラーの削減や開発時間の短縮が期待されます。 • AI技術を活用した新しい開発ツールの紹介 • コードの自動生成や補完機能を提供 • 開発者が入力したコメントや関数名に基づいて提案 • 多くのプログラミング言語に対応、特にJavaScriptやPythonが推奨 • コーディングの効率向上、エラー削減、開発時間短縮が期待される

Learn how to analyze data with ChatGPT by exploring datasets, generating insights, creating visualizations, and turning findings into actionable decisions.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。特に、AIを用いたコード生成やデバッグ支援の機能が強調されており、開発者が効率的に作業を進めるための具体的な手法が紹介されています。また、これらのツールがどのようにして開発プロセスを改善し、エラーを減少させるかについても触れています。さらに、実装方法や必要な環境についての詳細も提供されており、実際のプロジェクトにどのように適用できるかが示されています。 • AI技術を活用した新しい開発ツールの紹介 • コード生成やデバッグ支援の機能が強調されている • 開発プロセスの改善とエラーの減少に寄与する • 具体的な実装方法や必要な環境についての詳細が提供されている • 実際のプロジェクトへの適用方法が示されている

Learn how to use ChatGPT for writing to draft, revise, and refine content with clear structure, tone, and intent.

Learn how to use ChatGPT for research to gather sources, analyze information, and create structured, citation-backed insights.

この記事では、ChatGPTを安全かつ効果的に使用するためのベストプラクティスが紹介されています。AIは知識労働を変革する技術であり、ChatGPTは大量のデータを基に人間のような言語を生成しますが、誤った情報を生成する可能性があるため、注意が必要です。使用者は、職場のポリシーを尊重し、重要な作業には必ず人間を関与させるべきです。また、バイアスや視点に注意し、法的、医療的、財務的なアドバイスは専門家に確認することが推奨されています。AIの使用を透明にし、他者のデータを共有する際には同意を得ることが重要です。フィードバックを提供し、最新の情報を得るために検索機能を活用することも奨励されています。 • AIの安全で効果的な使用に関するベストプラクティスを提供 • 職場のポリシーを尊重し、重要な作業には人間を関与させるべき • ChatGPTは誤った情報を生成する可能性があるため、信頼できる情報源で確認する必要がある • バイアスや視点に注意し、出力を批判的に評価することが重要 • 法的、医療的、財務的なアドバイスは専門家に確認することが推奨される • AIの使用を透明にし、他者のデータを共有する際には同意を得ることが重要 • フィードバックを提供し、最新の情報を得るために検索機能を活用することが奨励されている

この記事では、ChatGPTを効果的に活用するためのプロンプト設計の基本について説明しています。プロンプトエンジニアリングは、ChatGPTに最適な回答を得るために入力を設計・洗練するプロセスです。良いプロンプトを書くための簡単なステップとして、タスクの概要を明確にし、役立つコンテキストを提供し、理想的な出力を説明することが挙げられています。また、複雑なタスクは小さなステップに分けることや、具体的でシンプルな要求を心がけることが推奨されています。さらに、選択肢を求めたり、優先事項を設定することも重要です。 • プロンプトエンジニアリングは、ChatGPTに最適な回答を得るための入力設計プロセスである。 • 良いプロンプトを書くためには、タスクの概要、役立つコンテキスト、理想的な出力を明確にすることが重要。 • 複雑なタスクは小さなステップに分けることで、明確で焦点を絞った回答を得やすくなる。 • 具体的でシンプルな要求を心がけることで、より良い応答が得られる。 • 選択肢を求めたり、優先事項を設定することで、ChatGPTの応答をカスタマイズできる。

この記事では、特定のタスクやワークフローに合わせたカスタムGPTの構築方法について説明しています。カスタムGPTは、ユーザーの指示に従い、チームのコンテキストを活用して、一貫した出力を生成することができます。これにより、繰り返し行う作業を効率化し、再説明やコピー&ペーストの手間を減らすことが可能です。カスタムGPTは、特定のニーズに基づいて設計され、ファイルのアップロードやツールの有効化が可能です。記事では、カスタムGPTの具体的な使用例や、作成手順についても詳しく説明されています。特に、定期的に行う作業や、同じプロンプトを繰り返し使用する場合に有効です。 • カスタムGPTは特定のタスクやワークフローに特化したChatGPTのバージョンである。 • カスタムGPTは、ユーザーの指示に従い、チームのコンテキストを活用して一貫した出力を生成する。 • 繰り返し行う作業を効率化し、再説明やコピー&ペーストの手間を減らすことができる。 • カスタムGPTの作成には、明確な目的を設定し、必要なフィールドを埋めることが重要である。 • 具体的な使用例として、FAQボットやライティングアシスタント、データ分析アシスタントなどが挙げられる。

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。これにより、開発者はコーディングの効率を大幅に向上させることができ、エラーの削減や開発時間の短縮が期待されます。 • AI技術を活用した新しい開発ツールの紹介 • コードの自動生成や補完機能を提供 • 開発者が入力したコメントや関数名に基づいて提案 • 多くのプログラミング言語に対応、特にJavaScriptやPythonが推奨 • コーディングの効率向上、エラー削減、開発時間短縮が期待される

この記事では、ChatGPTがオペレーションチームにどのように役立つかについて説明しています。オペレーションチームは情報と実行の交差点に位置し、ChatGPTは常時稼働するチーフオブスタッフのように機能します。散発的な情報を整理し、意思決定に必要な要約を提供することで、チームの作業を効率化します。具体的には、散らばった情報を明確な次のステップに変換し、ステータス更新を明確にすることで、同じ質問が繰り返されるのを防ぎます。また、定期的な業務を一貫性のあるものに保つために、標準化されたフォーマットを提供します。主な使用ケースには、運営のリズムと報告、プロセスと引き継ぎ、インシデント管理、ベンダーおよびパートナー業務、キャパシティと計画、メトリクスとデータの整合性が含まれます。オペレーションチームは、明確な運営コンテキストを提供することで、ChatGPTから最大の価値を引き出すことができます。 • オペレーションチームの情報と実行の交差点での役割を強化する。 • 散発的な情報を整理し、意思決定に必要な要約を提供する。 • ステータス更新を明確にし、同じ質問の繰り返しを防ぐ。 • 定期的な業務を標準化し、一貫性を持たせる。 • 主な使用ケースには運営のリズム、プロセス管理、インシデント管理、ベンダー業務、キャパシティ計画が含まれる。

Learn how to personalize ChatGPT using custom instructions and memory to get more relevant, consistent, and tailored responses.

Learn how customer success teams use ChatGPT to manage accounts, improve communication, reduce churn, and drive adoption and renewals.

Learn how to create and use ChatGPT skills to build reusable workflows, automate recurring tasks, and ensure consistent, high-quality outputs.

Learn how managers use ChatGPT to prepare for conversations, write clear feedback, stay organized, and improve team effectiveness.

ChatGPTでは、ファイルを直接アップロードして会話の中で分析、編集、生成が可能です。ユーザーは、ツールメニューから「写真やファイルを追加」を選択し、CSV、XLSX、PDF、DOCX、JPEG、PNG、TXTなどの形式のファイルをアップロードできます。アップロード後、レポートの要約やリスクの指摘、データの視覚化、文書の書き直し、PDFからのデータ抽出などのタスクを依頼できます。また、特定のビュー(テーブルやチャート)をリクエストしたり、ChatGPTが生成した出力をダウンロードすることも可能です。さらに、一部のChatGPTバージョンでは、外部ツールに接続するアプリを使用でき、会話に外部のコンテキストを持ち込むことができます。エンタープライズワークスペースでは、管理者が利用可能なアプリを制御します。アプリを通じてアクセスされたデータは、デフォルトではOpenAIモデルのトレーニングには使用されません。 • ChatGPTでファイルをアップロードし、分析や編集ができる機能がある。 • サポートされているファイル形式にはCSV、XLSX、PDF、DOCX、JPEG、PNG、TXTが含まれる。 • ユーザーはファイルをアップロード後、要約やデータの視覚化、文書の書き直しなどのタスクを依頼できる。 • 特定のビューをリクエストしたり、生成された出力をダウンロードすることが可能。 • 一部のバージョンでは外部ツールに接続するアプリを使用でき、外部のコンテキストを会話に持ち込むことができる。 • エンタープライズワークスペースでは、管理者が利用可能なアプリを制御し、データはデフォルトでモデルのトレーニングには使用されない。

この記事では、医療現場におけるAIの活用方法について説明しています。特に、ChatGPT for Healthcareが医療従事者向けに設計された安全な作業空間であり、HIPAAに準拠した使用が可能であることが強調されています。このツールは、臨床文書の作成、事前承認の準備、患者情報の要約など、医療従事者の業務を支援し、管理業務の負担を軽減し、患者ケアに集中できるようにします。具体的な使用例として、診断テストの選択、鑑別診断の作成、治療計画の策定に関するプロンプトが示されており、これにより医療従事者が日常業務を効率化できることが示されています。 • AIが医療現場での業務を支援する具体的な方法を示している • ChatGPT for HealthcareはHIPAA準拠の安全な作業空間である • 臨床文書作成や患者情報の要約などのタスクを支援する • 診断テストの選択や鑑別診断の作成に役立つプロンプトが提供されている • 医療従事者が業務を効率化し、患者ケアに集中できるようにする効果がある

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者はコーディングの効率を大幅に向上させることができ、エラーの削減や開発時間の短縮が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した情報に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • コーディング効率の向上が期待される • エラー削減や開発時間短縮のメリット

Learn how to use ChatGPT, start your first conversation, and discover simple ways to write, brainstorm, and solve problems with AI.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語で機能を入力することでコードを生成 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減が期待される • 多くのプログラミング言語に対応している

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されています。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した内容に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的で使いやすいユーザーインターフェース

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行うことができ、開発効率を大幅に向上させることが期待されています。さらに、ツールは多くのプログラミング言語に対応しており、さまざまな開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 多言語対応でさまざまな開発環境で利用可能 • 開発効率の向上が期待される

Learn how to create and refine images with ChatGPT using clear prompts, iterate on designs, and generate high-quality visuals in minutes.

Learn how sales teams use ChatGPT to research accounts, personalize outreach, manage deals, and improve pipeline and conversion.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での入力に基づくコードの自動生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の期待 • 多くのプログラミング言語に対応している

Today we're launching Cognition Japan, our first expansion into Asia, to partner with Japanese enterprises ready to transform how software gets built.

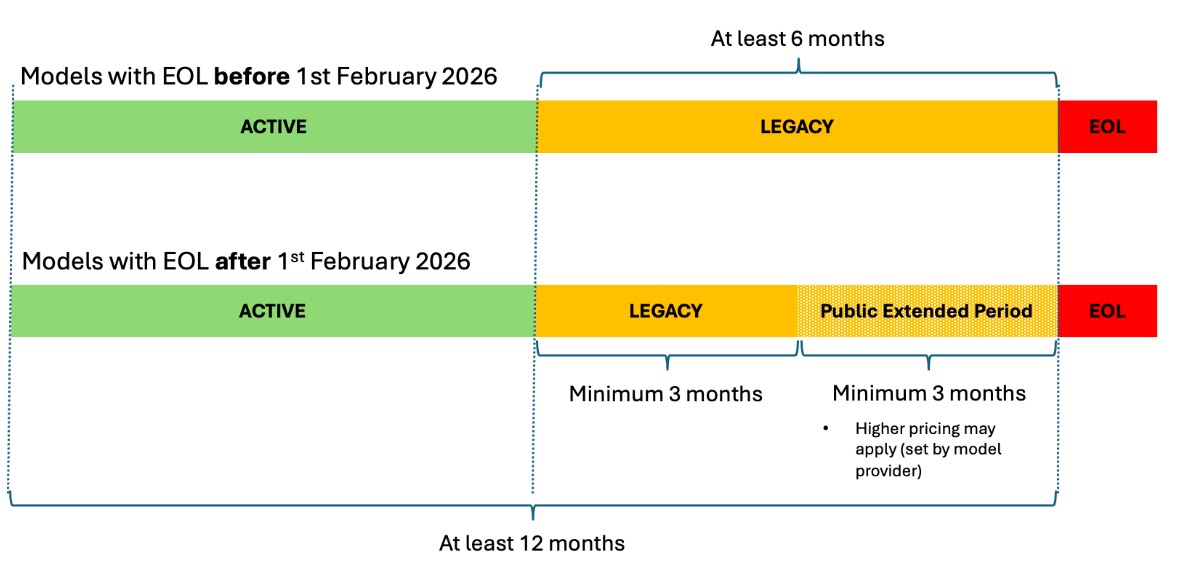

This post shows you how to manage FM transitions in Amazon Bedrock, so you can make sure your AI applications remain operational as models evolve. We discuss the three lifecycle states, how to plan migrations with the new extended access feature, and practical strategies to transition your applications to newer models without disruption.

Today, we're announcing AWS Agent Registry (preview) in AgentCore, a single place to discover, share, and reuse AI agents, tools, and agent skills across your enterprise.

This post walks you through three steps: starting a session and generating the Live View URL, rendering the stream in your React application, and wiring up an AI agent that drives the browser while your users watch. At the end, you will have a working sample application you can clone and run.

This year, we're doing it again. Interrupt 2026 is May 13–14 at The Midway in San Francisco, and the lineup, the format, and the scale have all leveled up.

Today we’re launching Deep Agents deploy in beta. Deep Agents deploy is the fastest way to deploy a model agnostic, open source agent harness in a production ready way. Deep Agents deploy is built for an open world. It’s built on Deep Agents - an open source, model

AI agents work best when they reflect the knowledge and judgment your team has built over time. Some of that is institutional knowledge that’s already documented and easy for an agent to use as-is. But most great organizations also rely on tacit knowledge that lives inside their employees’ minds.

In this post, you will learn how to build stateful MCP servers that request user input during execution, invoke LLM sampling for dynamic content generation, and stream progress updates for long-running tasks. You will see code examples for each capability and deploy a working stateful MCP server to Amazon Bedrock AgentCore Runtime.

ConvApparelは、LLM(大規模言語モデル)ベースのユーザーシミュレーターにおける「リアリズムギャップ」を定量化し、堅牢な会話エージェントのトレーニングを改善するために設計された新しい人間-AI会話データセットと評価フレームワークです。現代の会話AIエージェントは複雑なタスクを処理できますが、長時間の対話では制約を忘れたり、無関係な応答を生成したりすることが多いです。これを改善するためには、継続的なトレーニングとフィードバックが必要ですが、実際の人間テストに依存するのは高コストで時間がかかります。そこで、AI研究コミュニティはユーザーシミュレーターに注目していますが、現代のLLMベースのシミュレーターは依然としてリアリズムギャップに悩まされています。ConvApparelは、ユーザーシミュレーションの隠れた欠陥を明らかにし、信頼できるAIベースのテスターを構築するための道を提供します。データ収集プロトコルでは、参加者が「良い」エージェントまたは「悪い」エージェントにランダムにルーティングされ、人口統計統計、ヒューマンライクスコアリング、反事実検証を含む三本柱の検証戦略を用いています。これにより、単なる表面的な模倣を超えた人間行動の全範囲を捉えることができます。 • ConvApparelはLLMベースのユーザーシミュレーターのリアリズムギャップを定量化するための新しいデータセットと評価フレームワークを提供する。 • 現代の会話AIエージェントは長時間の対話で制約を忘れたり、無関係な応答を生成することが多い。 • ユーザーシミュレーターは、実際の人間テストに代わるスケーラブルな解決策として注目されている。 • ConvApparelは、良いエージェントと悪いエージェントの二重エージェントデータ収集プロトコルを使用している。 • 三本柱の検証戦略により、単なる表面的な模倣を超えた人間行動を捉えることができる。 • シミュレーターは新しい状況に対しても適切に反応する必要がある。 • 反事実検証の概念を導入し、シミュレーターが新しいエージェントにどのように適応するかを評価する。

The shift to agentic infrastructure. For fifty years, infrastructure assumed a human operator. Someone to configure the server, click the deploy button, or read the logs.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

Studio, Server, and Memory Gateway. Everything you need to run your agents at scale.

Mastra raises a $22M Series A led by Spark Capital, bringing total funding to $35M. Plus: the Mastra platform launches today.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に自然言語処理を用いた機能が強化されています。具体的には、開発者が自然言語で指示を出すと、AIがそれに基づいてコードを生成することが可能です。また、ツールは既存の開発環境に簡単に統合できるよう設計されており、ユーザーは特別な設定を行うことなく利用を開始できます。これにより、開発の効率が大幅に向上し、エラーの削減にも寄与します。さらに、AIの学習能力により、使用するほどに精度が向上する点も特徴です。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での指示に基づいてコードを生成する機能 • 既存の開発環境への簡単な統合 • 開発効率の向上とエラー削減 • 使用するほどに精度が向上するAIの学習能力

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が入力した要件に基づいて、AIが最適なコードを提案し、開発の効率を向上させることを目的としています。また、ツールの導入により、開発時間の短縮やエラーの減少が期待されると述べられています。さらに、実装方法や使用する際の注意点についても詳しく解説されています。 • AI技術を活用した新しい開発ツールの紹介 • 生成AIを利用したコードの自動生成や修正機能 • 開発者の要件に基づく最適なコード提案 • 開発効率の向上とエラーの減少が期待される • 実装方法や使用時の注意点についての解説

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での入力に基づくコードの自動生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の期待 • 多くのプログラミング言語に対応している

この記事では、学術研究のワークフローを改善するために、2つのAIエージェントを紹介しています。PaperVizAgentは、学術的な図を描くためのビジュアライザーエージェントであり、ScholarPeerは、学術論文を自動的かつ厳密に評価するレビュアーエージェントです。研究者は、PaperVizAgentを使用して、研究の方法論や統計的プロットを含む出版準備が整った図を生成できます。ScholarPeerは、文献に基づいた批評を提供し、従来の自動レビュアーよりも優れた評価を行います。これらのエージェントは、研究者が革新に集中できるように設計されており、学術研究のライフサイクルを支援します。 • 学術研究のワークフローを改善するためのAIエージェントの導入 • PaperVizAgentは、学術的な図を自動生成するビジュアライザーエージェント • ScholarPeerは、論文を自動的に評価するレビュアーエージェント • PaperVizAgentは、研究の方法セクションと図のキャプションを基に図を生成 • ScholarPeerは、文献に基づいた批評を提供し、従来の自動レビュアーよりも優れた評価を行う • これらのエージェントは、研究者が革新に集中できるように設計されている

In this post, we'll walk you through a complete implementation of model fine-tuning in Amazon Bedrock using Amazon Nova models, demonstrating each step through an intent classifier example that achieves superior performance on a domain specific task. Throughout this guide, you'll learn to prepare high-quality training data that drives meaningful model improvements, configure hyperparameters to optimize learning without overfitting, and deploy your fine-tuned model for improved accuracy and reduced latency. We'll show you how to evaluate your results using training metrics and loss curves.

In healthcare and life sciences, AI agents help organizations process clinical data, submit regulatory filings, automate medical coding, and accelerate drug development and commercialization. However, the sensitive nature of healthcare data and regulatory requirements like Good Practice (GxP) compliance require human oversight at key decision points. This is where human-in-the-loop (HITL) constructs become essential. In this post, you will learn four practical approaches to implementing human-in-the-loop constructs using AWS services.

This post walks you through understanding audio embeddings, implementing Amazon Nova Multimodal Embeddings, and building a practical search system for your audio content. You'll learn how embeddings represent audio as vectors, explore the technical capabilities of Amazon Nova, and see hands-on code examples for indexing and querying your audio libraries. By the end, you'll have the knowledge to deploy production-ready audio search capabilities.

In this post, we explore where RFT is most effective, using the GSM8K mathematical reasoning dataset as a concrete example. We then walk through best practices for dataset preparation and reward function design, show how to monitor training progress using Amazon Bedrock metrics, and conclude with practical hyperparameter tuning guidelines informed by experiments across multiple models and use cases.

By Vivek Trivedy, Product Manager @ LangChain 💡TL;DR: We can build better agents by building better harnesses. But to autonomously build a “better” harness, we need a strong learning signal to “hill-climb” on. We share how we use evals as that signal, plus design decisions that help our agent generalize

この記事では、画像や動画生成のための拡散モデルの効率的な実行を実現するために、MXFP8およびNVFP4というマイクロスケーリングフォーマットを使用した手法について説明しています。これらのフォーマットは、NVIDIAのBlackwellアーキテクチャにネイティブにサポートされており、メモリと計算リソースの要求を軽減します。具体的には、MXFP8は8ビットのフォーマットで、BF16よりも高速な推論を提供し、NVFP4は4ビットの浮動小数点フォーマットで、特に高バッチの計算負荷の高いワークロードに最適です。記事では、これらのフォーマットを使用した場合の推論速度の向上を示し、CUDAグラフやLPIPSを用いた精度とパフォーマンスの最適化についても触れています。 • MXFP8とNVFP4は、NVIDIAのBlackwellアーキテクチャに対応したマイクロスケーリングフォーマットである。 • MXFP8は8ビットフォーマットで、BF16よりも高速な推論を実現し、視覚品質の損失がほとんどない。 • NVFP4は4ビットフォーマットで、メモリフットプリントがBF16の約3.5倍小さく、高バッチの計算負荷に適している。 • CUDAグラフやLPIPSを用いて、モデルの精度とパフォーマンスを最適化する手法が紹介されている。 • 実験の再現に必要なコードが提供されている。

Find out how you can get more ROI from AI, manage AI costs effectively, and turn AI adoption into lasting business value.

A Blog post by IBM Research on Hugging Face

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に自動補完機能やエラーチェック機能が強化されています。また、ユーザーインターフェースが直感的で使いやすく、初心者でも簡単に扱えるように設計されています。さらに、既存の開発環境との互換性が高く、導入が容易であることも特徴です。これにより、開発の効率が向上し、エラーの発生を減少させることが期待されています。 • AI技術を活用した新しい開発ツールの紹介 • 自動補完機能やエラーチェック機能が強化されている • 直感的で使いやすいユーザーインターフェース • 初心者でも簡単に扱える設計 • 既存の開発環境との高い互換性 • 導入が容易で開発効率が向上することが期待される

Monarchは、PyTorch用の分散プログラミングフレームワークで、巨大なクラスター上での分散トレーニングジョブを簡単に実行できるように設計されています。これにより、スーパコンピュータを直接制御可能なシステムとして扱うことができ、ローカル開発の体験を大規模トレーニングに持ち込むことができます。Monarchは、エージェントが開発タスクを効率的に実行できるように、RDMAを利用したリモートファイルシステムや分散SQLテレメトリを提供します。また、KubernetesやSLURMとの統合が可能で、リソースを一度プロビジョニングすれば、必要なだけのジョブを実行できます。Monarchは、エージェント駆動のトレーニング開発を強化し、デバッグや依存関係の同期を迅速に行えるようにします。 • Monarchは分散トレーニングジョブを簡単に実行できるフレームワークである。 • スーパコンピュータを直接制御可能なシステムとして扱うことができる。 • RDMAを利用したリモートファイルシステムにより、コードや依存関係を迅速に同期できる。 • 分散SQLテレメトリを使用して、ライブ状態情報を収集し、デバッグを容易にする。 • KubernetesやSLURMとの統合が可能で、リソースを一度プロビジョニングすれば、複数のジョブを実行できる。

この記事では、深層学習における正規化手法であるLayerNormとRMSNormのtorch.compileによるパフォーマンス向上について評価しています。NVIDIA H100およびB200でのカーネルごとの性能を向上させ、ほぼ最先端のパフォーマンスを達成することを目指しています。LayerNormは平均と分散を用いて入力を正規化し、RMSNormは平方和を用いて正規化します。Quackというライブラリを基準にtorch.compileの性能を評価し、torch.compileがQuackの約50%の性能であることを確認しました。最終的に、オートチューニングを行い、Inductorのデフォルトを改善することで、H100およびB200での最先端性能を達成しました。 • LayerNormとRMSNormは深層学習における重要な正規化手法である。 • torch.compileの性能をNVIDIA H100およびB200で評価し、最先端のパフォーマンスを目指した。 • Quackライブラリを基準にtorch.compileの性能を比較した結果、torch.compileはQuackの約50%の性能であった。 • オートチューニングを行い、Inductorのデフォルト設定を改善することで、性能を向上させた。 • 特に、内側の削減RBLOCKをスケールアップし、持続的な削減のXBLOCKを調整した。

Enforce zero data retention across your entire team and prevent providers from training on your data. AI Gateway handles routing and provider agreements for you.

Discover OpenAI’s Child Safety Blueprint—a roadmap for building AI responsibly with safeguards, age-appropriate design, and collaboration to protect and empower young people online.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

Edit agent instructions, tools, and display conditions from Studio with draft/publish versioning, or programmatically through the editor API.

With Amazon Bedrock Projects, you can attribute inference costs to specific workloads and analyze them in AWS Cost Explorer and AWS Data Exports. In this post, you will learn how to set up Projects end-to-end, from designing a tagging strategy to analyzing costs.

We're releasing SWE-1.6, our latest model optimized for both intelligence and model UX.

TL;DR: We’ve released new minor versions of deepagents & deepagentsjs, featuring async (non-blocking) subagents, expanded multi-modal filesystem support, and more. See the changelog for details. Async subagents Deep Agents can now delegate work to remote agents that run in the background. As opposed to the existing inline subagents, which

This post walks through building an automated podcast generator that creates engaging conversations between two AI hosts on any topic, demonstrating the streaming capabilities of Nova Sonic, stage-aware content filtering, and real-time audio generation.

In this post, we show you how to build a natural text-to-SQL solution using Amazon Bedrock that transforms business questions into database queries and returns actionable answers.

Arcade is the MCP runtime for production agents, delivering secure agent authorization, reliable tools, and governance. This integration gives your agents access to Arcade’s collection of 7,500+ agent-optimized tools through a single secure gateway.

This article was written by Andrew Green, technical writer and industry analyst. We pay Andrew, but he refuses to write anything else but his own opinion. The big boys entered the market, OpenClaw appropriated the MCP security strategy, and everyone started vibe coding but only if they already knew how

Apollo Skills cut AI agent token usage and completion time down significantly — same result, far less cost. Here's what the experiment revealed.

Use Anthropic's Fast Mode feature for 2.5x faster output token speeds with Opus 4.6 on AI Gateway now.

この記事では、TorchInductorに新たに統合されたCuteDSLバックエンドについて説明しています。TorchInductorは、行列乗算のためにTriton、CUTLASS(C++)、cuBLASの3つの自動調整バックエンドをサポートしており、CuteDSLはその4番目のバックエンドとして追加されました。CuteDSLは、NVIDIAが開発を進めており、最適化されたカーネルテンプレートを提供することで、TorchInductorのメンテナンス負担を軽減します。さらに、CuteDSLはPythonで書かれており、コンパイル時間が短く、CUTLASS C++よりも維持管理が容易です。GEMM(行列の積)操作は、トランスフォーマーモデルの計算プロファイルの大部分を占めており、これらの操作の最適化が重要です。CuteDSLは、最新のNVIDIAハードウェアでの最適なGEMMパフォーマンスを提供するために適したバックエンドとされています。 • TorchInductorにCuteDSLを新たに統合したこと • CuteDSLはNVIDIAが開発しており、最適化されたカーネルテンプレートを提供 • メンテナンス負担が軽減され、コンパイル時間が短縮される • CuteDSLはPythonで書かれており、CUTLASS C++よりも維持管理が容易 • GEMM操作はトランスフォーマーモデルの計算プロファイルの大部分を占める • CuteDSLは最新のNVIDIAハードウェアでの最適なGEMMパフォーマンスを提供するために適している

You can now access GLM 5.1 on Vercel's AI Gateway with no markup and no other provider accounts required.

In this post, we walk through building a custom HR onboarding agent with Quick. We show how to configure an agent that understands your organization’s processes, connects to your HR systems, and automates common tasks, such as answering new-hire questions and tracking document completion.

In this post, we walk through how we fine-tuned Qwen 2.5 7B Instruct for tool calling using RLVR. We cover dataset preparation across three distinct agent behaviors, reward function design with tiered scoring, training configuration and results interpretation, evaluation on held-out data with unseen tools, and deployment.

In this post, we show how to implement a generative AI agentic assistant that uses both semantic and text-based search using Amazon Bedrock, Amazon Bedrock AgentCore, Strands Agents and Amazon OpenSearch.

This blog post demonstrates how Windward helps enhance and accelerate alert investigation processes by combining geospatial intelligence with generative AI, enabling analysts to focus on decision-making rather than data collection.

Amazon Bedrock AgentCore Gateway provides a centralized layer for managing how AI agents connect to tools and MCP servers across your organization. In this post, we walk through how to configure AgentCore Gateway to connect to an OAuth-protected MCP server using the Authorization Code flow.

Build a production-ready RAG system architecture. Understand core components, how to implement, challenges, and best practices.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIがリアルタイムでサポートを提供し、効率的なコーディングを実現します。具体的には、AIがコードの提案やエラーチェックを行い、開発者の生産性を向上させることを目的としています。また、ツールの導入方法や設定手順についても詳しく解説されており、特に初心者にとっても使いやすい設計がされています。さらに、AIの学習データとして多様なプログラミング言語が使用されており、幅広い開発環境に対応可能です。 • AI技術を活用した新しい開発ツールの紹介 • リアルタイムでのコード提案やエラーチェック機能 • 開発者の生産性向上を目的とした設計 • 初心者にも使いやすい導入方法と設定手順 • 多様なプログラミング言語に対応した学習データの使用

Vercel AI Gateway supports Zero Data Retention and No Prompt Training controls. Enforce data policies team-wide from the dashboard or per-request, with automatic routing to compliant models from Anthropic, OpenAI, Google, and many more.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に自然言語処理を用いたコード生成機能が特徴です。具体的には、開発者が自然言語で指示を出すと、それに基づいてコードを自動生成することが可能です。また、ツールは既存のコードベースとの互換性があり、簡単に導入できる点も強調されています。さらに、AIによるコードレビュー機能も搭載されており、品質向上に寄与することが期待されています。 • AIを活用したコード生成ツールの紹介 • 自然言語での指示に基づくコード自動生成機能 • 既存のコードベースとの互換性がある • 簡単に導入できる設計 • AIによるコードレビュー機能の搭載

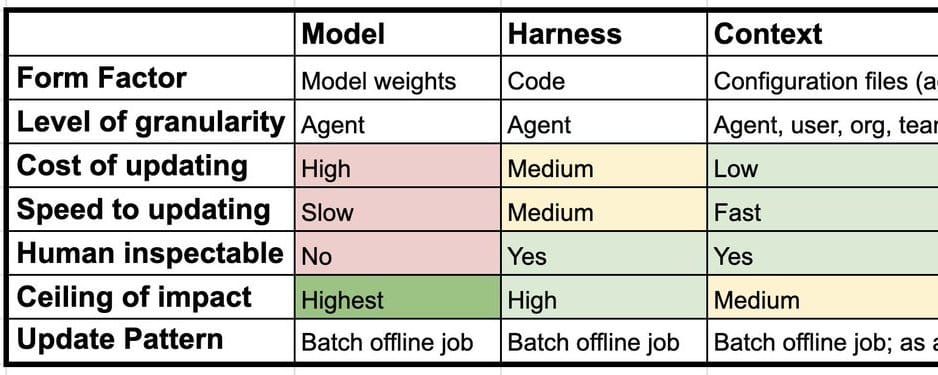

Most discussions of continual learning in AI focus on one thing: updating model weights. But for AI agents, learning can happen at three distinct layers: the model, the harness, and the context. Understanding the difference changes how you think about building systems that improve over time. The three main layers

本記事では、LLM(大規模言語モデル)の行動傾向の評価と整合性についての体系的な評価フレームワークを紹介しています。このフレームワークは、モデルの行動傾向を人間の社会的傾向と比較し、モデルの出力と人間の合意との間の整合性や逸脱を定量化することを目的としています。具体的には、共感や自己主張などの特性を評価するための標準化された心理学的質問票を用いて、LLMの行動傾向を評価します。研究では、プロフェッショナルな落ち着きや対立解決、日常的な意思決定など、現実的なユーザーアシスタントシナリオにおけるLLMの行動を分析しました。25のLLMを対象にした大規模な分析の結果、モデルの傾向が人間の合意から逸脱している場合や、合意がない場合に人間の意見の範囲を捉えられていない場合があることが明らかになりました。今後の研究では、これらの結果を基に、モデルの行動の整合性を向上させる機会が期待されています。 • LLMの行動傾向を評価するための体系的なフレームワークを導入 • モデルの出力と人間の合意との整合性を定量化 • 心理学的質問票を用いてLLMの行動傾向を評価 • 現実的なユーザーアシスタントシナリオでのモデルの行動を分析 • 25のLLMを対象にした大規模な分析で2種類のギャップを特定 • モデルの行動が人間の合意から逸脱する場合がある • 今後の研究でモデルの行動の整合性を向上させる機会が期待される

💡TL;DR: Open models like GLM-5 and MiniMax M2.7 now match closed frontier models on core agent tasks — file operations, tool use, and instruction following — at a fraction of the cost and latency. Here's what our evals show and how to start using them in Deep Agents. Over the

In this post, we explore how ActorSimulator in Strands Evaluations SDK addresses the challenge with structured user simulation that integrates into your evaluation pipeline.

Gemma 4: our most intelligent open models to date, purpose-built for advanced reasoning and agentic workflows.

Google is introducing two new inference tiers to the Gemini API, Flex and Priority, to balance cost and latency.

Create MCP servers directly in Nuxt apps with type-safe tools, resources, and prompts for AI integrations.

This post describes how TGS achieved near-linear scaling for distributed training and expanded context windows for their Vision Transformer-based SFM using Amazon SageMaker HyperPod. This joint solution cut training time from 6 months to just 5 days while enabling analysis of seismic volumes larger than previously possible.

In this post, we show you how to configure AWS Network Firewall to restrict AgentCore resources to an allowlist of approved internet domains. This post focuses on domain-level filtering using SNI inspection — the first layer of a defense-in-depth approach.

Through a strategic partnership with the AWS Generative AI Innovation Center (GenAIIC), Rocket Close developed an intelligent document processing solution that has significantly reduced processing time, making the process 15 times faster. The solution, which uses Amazon Textract for OCR processing and Amazon Bedrock for foundation models (FMs), achieves a strong 90% overall accuracy in document segmentation, classification, and field extraction.

In this post, we go through how to use managed session storage to persist your agent's filesystem state and how to execute shell commands directly in your agent's environment.

Using AI for every workflow step isn't just unnecessary — it's slower, costlier, and less reliable when rule-based logic fits. This post covers practical patterns for combining deterministic and AI steps in n8n, with downloadable templates and hands-on exercises for each.

A foundation for anyone new to n8n, covering the platform concepts you'll see throughout the Production AI Playbook series.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコードの意図を理解し、適切なコードスニペットを提案する機能があります。また、ユーザーインターフェースは直感的で使いやすく、開発者が迅速に作業を進められるように設計されています。さらに、このツールは既存の開発環境に簡単に統合できるため、導入のハードルが低い点も強調されています。 • AI技術を活用した新しい開発ツールの紹介 • コードの自動生成や補完機能を提供 • 開発者の意図を理解し、適切なコードスニペットを提案 • 直感的で使いやすいユーザーインターフェース • 既存の開発環境に簡単に統合可能

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。これにより、開発者はコーディングの効率を大幅に向上させることができ、エラーの削減や開発時間の短縮が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した内容に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • コーディング効率の向上が期待される • エラー削減や開発時間短縮のメリット

You can now access Qwen 3.6 Plus from Alibaba on Vercel's AI Gateway with no markup and no other provider accounts required.

You can now access Gemma 4 models (26B and 31B) on Vercel's AI Gateway with no markup and no other provider accounts required.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.