Last updated: 2026/04/26 13:01

Learn what's new in Visual Studio Code 1.118 (Insiders)

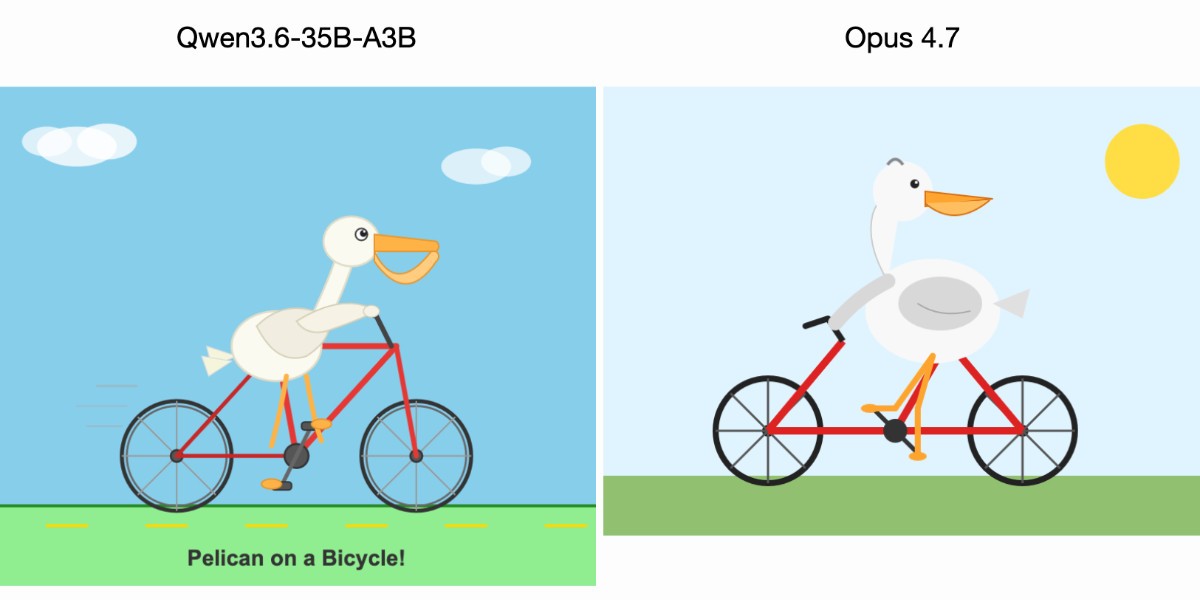

@scottjla on Twitter in reply to my pelican riding a bicycle benchmark: I feel like we need to stack these tests now I checked to confirm that the model (ChatGPT …

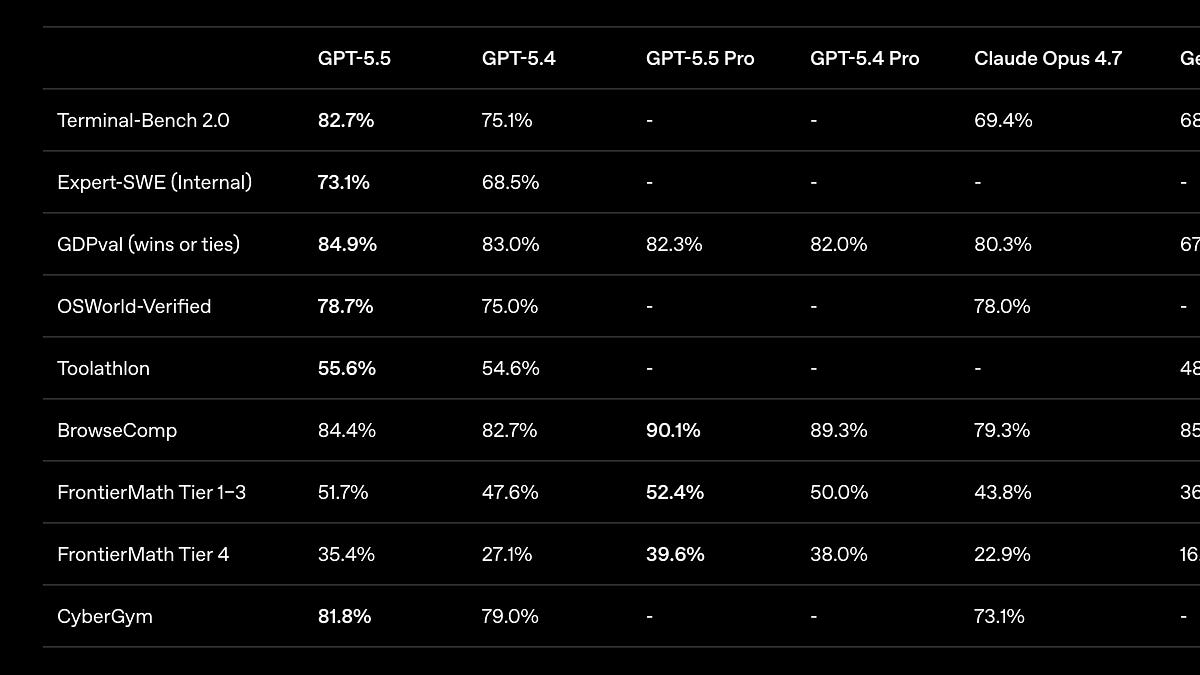

GPT-5.5, DeepSeek-V4 Preview, Kimi K2.6 Agent Swarm, Diversity Collapse, Sakana Fugu, and More

Since GPT-5.4, we’ve unified Codex and the main model into a single system, so there’s no separate coding line anymore. GPT-5.5 takes this further, with strong gains in agentic coding, …

Start your second innings with ChatGPT Credits Director: Abhinav Pratiman DOP: Tassaduq Hussain Production House: Early Man Film Creative agency: Hue & Why

Now that GPT-5.5 is available in the API, OpenAI have released a wealth of useful tips on how best to prompt the new model. Here's a neat trick they recommend …

Access large language models from the command-line

This written and video essay by Nilay Patel explores why AI is unpopular with the general public even as usage numbers for ChatGPT continue to skyrocket. It’s a superb piece …

“I thought building this internal tool was going to take me days…but with Codex and GPT-5.5, I was able to do it in under an hour.” Denis from Perplexity saw GPT-5.5 cut token usage by 56% while running the same agentic workflows faster and more efficiently. Build with GPT-5.5: https://openai.com/index/introducing-gpt-5-5/

Watch a guided walkthrough of an agent that pulls Friday metrics, creates charts, drafts the narrative, and delivers a ready-to-share business report.

Introducing workspace agents in ChatGPT—Codex-powered agents for teams. Watch a guided walkthrough of an agent that reviews software requests, checks policy, routes approvals, and opens IT tickets with clear next steps.

Introducing workspace agents in ChatGPT—Codex-powered agents for teams. Watch a guided walkthrough of an agent that screens vendors for sanctions, financial, and reputational risk, then turns the findings into a clear report.

While Shaunak Joshi grabbed a snack, GPT-5.5 in Codex refactored his entire code base. GPT-5.5 is our smartest and most intuitive model and NVIDIA AI researchers are seeing a 10x speed improvement in running experiments. “The magic moment was just the fact that it had enough intelligence to come back to me with a solution based on this very abstract question” We love to hear it. Build with GPT-5.5 ➡️ https://openai.com/index/introducing-gpt-5-5/

この記事は、GitHub上でのlangchain-openaiライブラリのバージョン1.2.1のリリースに関する情報を提供しています。このリリースでは、いくつかの重要な変更が行われました。具体的には、最小コアバージョンの引き上げ、Responses APIチェックにgpt-5.5 proを追加、コンテンツブロック中心のストリーミング機能の追加、モデルプロファイルデータの更新が含まれています。これにより、ライブラリの機能性とパフォーマンスが向上しています。 • langchain-openaiライブラリのバージョン1.2.1がリリースされた • 最小コアバージョンが引き上げられた • Responses APIチェックにgpt-5.5 proが追加された • コンテンツブロック中心のストリーミング機能が追加された • モデルプロファイルデータが更新された

Organize your home and digital space with Gemini. Use AI-powered tips for cleaning schedules, inbox decluttering, seasonal chores.

この記事は、GitHub上でのlanggraph-prebuiltのバージョン1.0.11のリリースに関する情報を提供しています。このリリースでは、ToolNodeツールがlist[Command | ToolMessage]を返すことを可能にする機能が追加され、ToolRuntimeで利用可能なツールが公開されました。また、バージョン1.1.8から1.1.9へのバージョンアップも行われています。これにより、ユーザーはより多くのツールを利用できるようになり、機能の拡張が図られています。 • ToolNodeツールがlist[Command | ToolMessage]を返す機能が追加された • ToolRuntimeで利用可能なツールが公開された • バージョン1.1.8から1.1.9へのバージョンアップが行われた • ユーザーはより多くのツールを利用できるようになった • 機能の拡張が図られた

In this post, we show how connecting the Visier Workforce AI platform with Amazon Quick through Model Context Protocol (MCP) gives every knowledge worker a unified agentic workspace to ask questions in. Visier helps ground the workspace in live workforce data and the organizational context that surrounds it while letting your users act on the conversational results without switching tools.

この記事は、Langchainのコアライブラリのバージョン1.3.2のリリースに関する情報を提供しています。このリリースでは、主にコンテンツブロック中心のストリーミング機能が追加されました。具体的には、バージョン1.3.1からの変更点として、ストリーミング機能の改善が挙げられています。リリース日は2023年4月24日で、GitHub上でのコミットが確認されています。 • Langchainのコアライブラリのバージョン1.3.2がリリースされた。 • 新機能としてコンテンツブロック中心のストリーミングが追加された。 • リリース日は2023年4月24日である。 • バージョン1.3.1からの主な変更点はストリーミング機能の改善である。

この記事では、mastraの新しいリリース(バージョン1.27.0)について説明しています。このリリースでは、CLI駆動のブラウザ自動化とスクリーンキャスト機能が追加され、@mastra/coreと新しい@mastra/browser-viewerパッケージがCLIベースのエージェントワークフローに対してエンドツーエンドのブラウザ自動化を提供します。BrowserViewerはPlaywrightを使用してChromeを起動し、リモートデバッグを行います。また、S3のサブディレクトリをマウントする機能や、並列foreachのワークフロー再開のバグ修正、観察メモリの改善も含まれています。新しいパッケージ@mastra/tavilyも追加され、さまざまなツールを提供します。 • CLI駆動のブラウザ自動化とスクリーンキャスト機能の追加 • BrowserViewerがPlaywrightを使用してChromeを起動し、リモートデバッグを行う • S3のサブディレクトリをマウントする機能の追加 • 並列foreachのワークフロー再開に関するバグ修正 • 観察メモリの改善により、ユーザーが10分以上後に戻った際のシステムリマインダーの挿入が可能に • 新しいパッケージ@mastra/tavilyの追加、さまざまなツールを提供

You can now access GPT 5.5 and GPT 5.5 Pro on Vercel's AI Gateway with no markup and no other provider accounts required.

Chinese AI lab DeepSeek’s last model release was V3.2 (and V3.2 Speciale) last December. They just dropped the first of their hotly anticipated V4 series in the shape of two …

Millisecond Converter

This week's edition of my email newsletter (aka content from this blog delivered to your inbox) features 4 pelicans riding bicycles, 1 possum on an e-scooter, up to 5 raccoons …

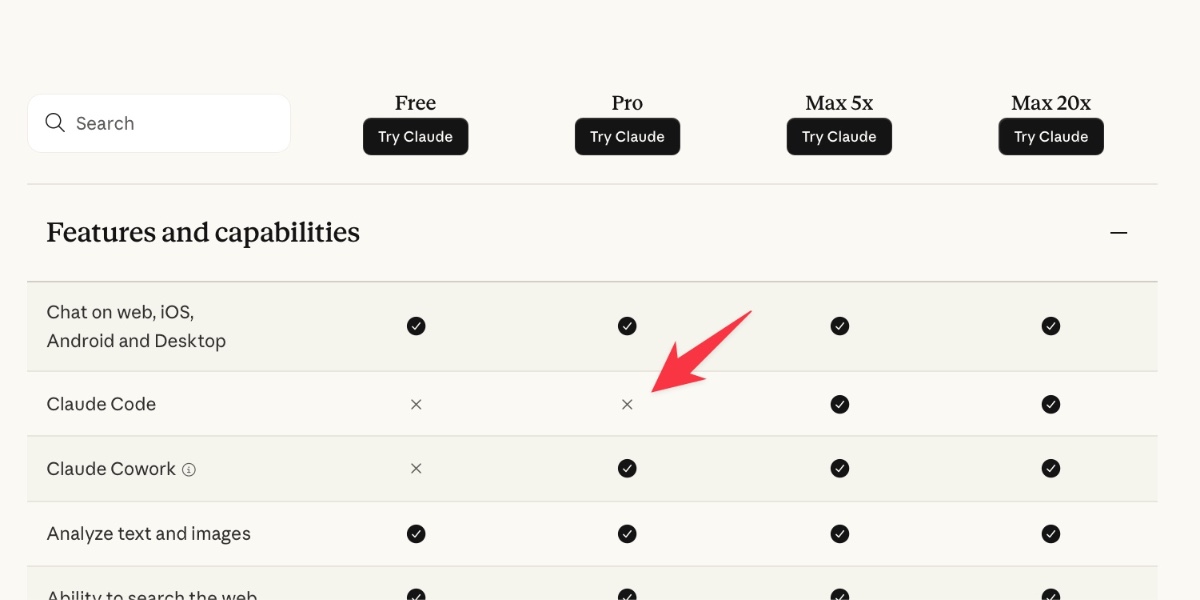

It turns out the high volume of complaints that Claude Code was providing worse quality results over the past two months was grounded in real problems. The models themselves were …

Your Mastra agents can now browse and take actions on the web, just like you can.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

RooCodeIncのGitHubリポジトリで、バージョン3.53.0がリリースされたことが発表されました。このリリースは2023年4月23日に行われ、リリースノートには新機能や修正点が含まれている可能性がありますが、具体的な内容は記載されていません。リリースに関連するアセットも提供されていますが、詳細は不明です。ユーザーはGitHub上でこのリリースに対して反応を示すことができ、リアクションが記録されています。 • RooCodeIncのリポジトリでバージョン3.53.0がリリースされた。 • リリース日は2023年4月23日。 • リリースノートには新機能や修正点が含まれる可能性があるが、具体的な内容は記載されていない。 • リリースに関連するアセットが提供されている。 • ユーザーはGitHub上でリリースに対してリアクションを示すことができる。

"GPT-5.5’s superpower is that it can just get things done.” It’s so cool to see how masters of the AI universe like NVIDIA’s Dennis Hannusch are leveraging GPT-5.5-Codex for complex engineering tasks. Be like Dennis. Build with GPT-5.5: https://openai.com/index/introducing-gpt-5-5/

Romain Huet chats with Aaron Friel, Member of Technical Staff @ OpenAI about the new GPT-5.5 model. Find out how teams within OpenAI are taking advantage of faster and more autonomous long-running tasks using GPT-5.5.

Find out what Claire Vo, founder of ChatPRD and host of How I AI, thinks about GPT-5.5. Claire talks about squashing bugs in ChatPRD and how GPT-5.5 is enabling new workflows.

Romain Huet chats with Will Koh from Ramp. Will is a Senior Software Engineer who has been working with GPT-5.5. Find out how GPT-5.5 improves Ramp's harness through much more intelligent tool finding and how this will benefit their customers.

GPT-5.5 is out. It’s available in OpenAI Codex and is rolling out to paid ChatGPT subscribers. I’ve had some preview access and found it to be a fast, effective and …

この記事は、Hugging FaceのTransformersライブラリのバージョン5.6.2のパッチリリースについて説明しています。このリリースでは、Qwen 3.5および3.6のMoE(Mixture of Experts)モデルがFP8(Float 8)を使用する際に発生していた問題が修正され、再び正常に動作するようになりました。また、カーネルの設定読み込みとエラーハンドリングに関する修正も行われています。これにより、ユーザーはこれらのモデルを問題なく利用できるようになります。 • Qwen 3.5および3.6のMoEモデルがFP8使用時に発生していた問題を修正 • カーネルの設定読み込みとエラーハンドリングの改善 • ユーザーがこれらのモデルを正常に利用できるようになった

Will Koh, Claire Voh, and Aaron Friel share their first impressions of GPT-5.5

Introducing GPT-5.5 A new class of intelligence for real work and powering agents, built to understand complex goals, use tools, check its work, and carry more tasks through to completion. It marks a new way of getting computer work done. Now available in ChatGPT and Codex.

Building cloud agents is difficult. We share some learnings from building Devin.

Cricket Australia Live app brings the game closer to fans with Microsoft AI powered rich insights

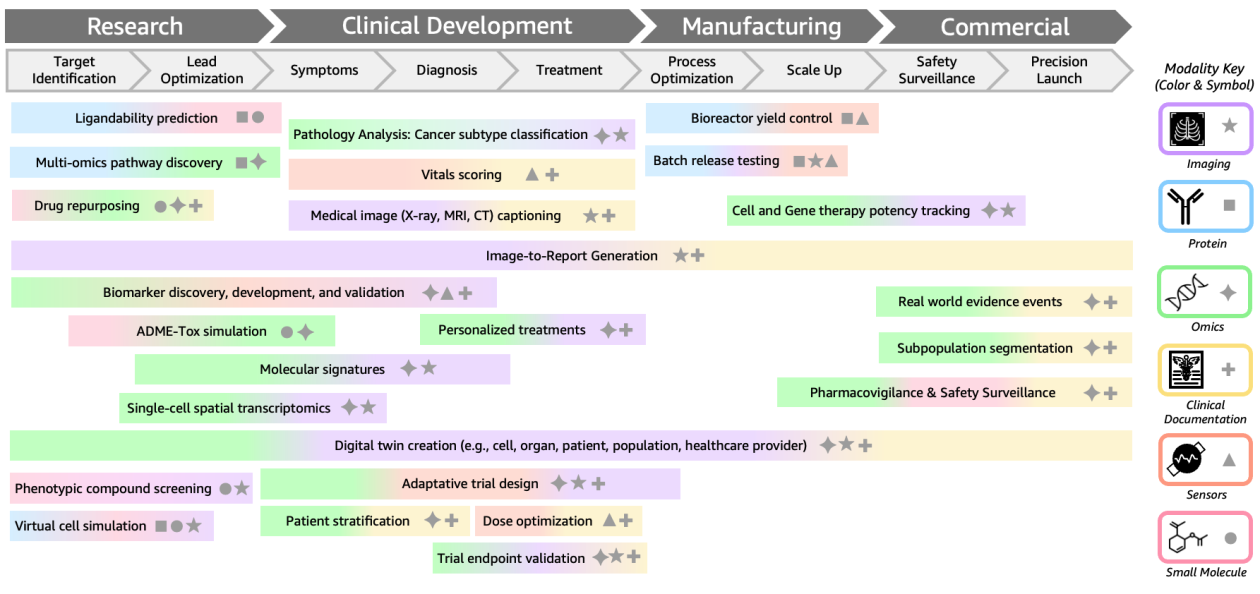

In this post, we'll explore how multimodal BioFMs work, showcase real-world applications in drug discovery and clinical development, and contextualize how AWS enables organizations to build and deploy multimodal BioFMs.

[...] if you ever needed another reason to learn in public by digital gardening or podcasting or streaming or whathaveyou, add on that people will assume you’re more competent than …

Learn how Google’s TPUs power increasingly demanding AI workloads with this new video.

The panel digs into the Cloudflare vs Vercel turf war over Next.js, breaking down what it really means that one engineer vibe coded a full framework rewrite in a week for $1,100 using Claude Code. Then things get spicy: from the Lovable data breach to an early Anthropic model escaping its sandbox, the crew debates whether the wave of AI security incidents is systemic, and what the build vs buy collapse means for developers rolling their own tools in the AI agent era.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に自然言語処理を用いた機能が強化されています。具体的には、開発者が自然言語で指示を出すと、AIがそれに基づいてコードを生成することが可能です。また、ツールは既存の開発環境に簡単に統合できるよう設計されており、ユーザーは特別な設定を行うことなくすぐに利用を開始できます。さらに、AIによるコード生成は、開発の効率を大幅に向上させることが期待されています。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での指示に基づいてコードを生成する機能 • 既存の開発環境への簡単な統合 • 開発効率の向上が期待される • 自然言語処理を用いた強化された機能

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されており、導入のハードルが低い点も特徴です。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的なユーザーインターフェースで導入が容易

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやTypeScriptプロジェクトでの使用が推奨 • 既存の開発環境に簡単に統合可能 • 開発効率の向上とエラー削減が期待される

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特にJavaScriptやTypeScriptのプロジェクトにおいて効果を発揮します。具体的には、コードの自動生成やエラーチェック、最適化提案などの機能があり、開発の効率を大幅に向上させることが期待されています。また、ユーザーインターフェースも直感的で使いやすく設計されており、導入のハードルが低い点も特徴です。さらに、クラウドベースでの運用が可能で、チームでの共同作業を円滑にするための機能も備えています。 • AI技術を活用した新しい開発ツールの紹介 • JavaScriptやTypeScriptプロジェクトに特化した機能 • コードの自動生成、エラーチェック、最適化提案が可能 • 開発効率を大幅に向上させることが期待される • 直感的で使いやすいユーザーインターフェース • クラウドベースでの運用が可能 • チームでの共同作業を円滑にする機能を備えている

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部を基に、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案する機能 • JavaScriptやTypeScriptプロジェクトへの統合が容易 • 開発効率の向上とエラー削減が期待される

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発者は効率的に作業を進めることができ、エラーの削減や生産性の向上が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発者の生産性向上とエラー削減の期待 • 多くのプログラミング言語に対応

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されています。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した内容に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的で使いやすいユーザーインターフェース

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントやコードの一部に基づいて、AIが適切なコードを提案する機能があります。また、このツールは既存の開発環境に簡単に統合できるように設計されており、特にJavaScriptやTypeScriptのプロジェクトでの使用が推奨されています。これにより、開発の効率が向上し、エラーの削減が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力したコメントに基づいてコードを提案 • JavaScriptやTypeScriptプロジェクトでの使用が推奨 • 既存の開発環境に簡単に統合可能 • 開発効率の向上とエラー削減が期待される

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が入力した要件に基づいて、AIが最適なコードを提案し、開発の効率を向上させることを目的としています。また、ツールの導入により、開発時間の短縮やエラーの減少が期待されると述べられています。さらに、ユーザーインターフェースも直感的で使いやすく設計されており、幅広い開発者に対応できるようになっています。 • AI技術を活用した新しい開発ツールの紹介 • 生成AIを利用してコードの自動生成や修正を行う • 開発者が入力した要件に基づいて最適なコードを提案 • 開発時間の短縮やエラーの減少が期待される • 直感的で使いやすいユーザーインターフェースを提供

Google has been a proud part of Austria’s landscape for years, and today, we’re announcing our first data center in Kronstorf, generating 100 direct jobs. This facility …

この記事は、Hugging FaceのTransformersライブラリのバージョン5.6.1のパッチリリースについて説明しています。このリリースでは、フラッシュアテンションパスに関する問題が修正され、特にs_aux=Noneの際に発生するAttributeErrorが解決されました。リリースは2023年4月23日に行われ、9件のコミットがメインブランチに追加されています。 • フラッシュアテンションパスの問題が修正された • s_aux=Noneの際に発生するAttributeErrorが解決された • 2023年4月23日にリリースされた • 9件のコミットがメインブランチに追加された

You can now access Deepseek V4 on Vercel's AI Gateway with no markup and no other provider accounts required.

この記事は、GitHub上でのlangchain-openaiライブラリのバージョン1.2.0のリリースに関する情報を提供しています。このリリースでは、ChatOpenAIにおけるサイレントストリーミングのハングを防ぐ機能が追加され、CIのnobenchmarkフラグが削除され、統合テストの呼び出しが標準化されました。これにより、ライブラリの安定性とパフォーマンスが向上することが期待されます。 • ChatOpenAIにおけるサイレントストリーミングのハングを防ぐ機能が追加された。 • CIのnobenchmarkフラグが削除された。 • 統合テストの呼び出しが標準化された。 • ライブラリの安定性とパフォーマンスが向上することが期待される。

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広いプロジェクトで利用可能です。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での入力に基づくコードの自動生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の期待 • 多くのプログラミング言語に対応

Multi-agent AI systems fail silently. Learn what proper observability looks like when agents orchestrate agents, and how Sentry keeps you in control.

In this post, we walk through building a scalable, event-driven transcription pipeline that automatically processes audio files uploaded to Amazon Simple Storage Service (Amazon S3), and show you how to use Amazon EC2 Spot Instances and buffered streaming inference to further reduce costs.

Watch a guided walkthrough of an agent that reviews software requests, checks policy, routes approvals, and opens IT tickets with clear next steps.

Today, Amazon SageMaker AI supports optimized generative AI inference recommendations. By delivering validated, optimal deployment configurations with performance metrics, Amazon SageMaker AI keeps your model developers focused on building accurate models, not managing infrastructure.

Today, we're introducing new capabilities that further streamline the agent building experience, removing the infrastructure barriers that slow teams down at every stage of agent development from the first prototype through production deployment.

この記事は、langgraph-cliのバージョン0.4.24のリリースに関する情報を提供しています。このリリースは2023年4月22日に行われ、主にCLIのフォーマットの修正と、3つのディレクトリにわたるpipグループの依存関係の更新が含まれています。リリースノートには、前のバージョン0.4.23からの変更点が記載されており、GitHub上でのコミット情報も確認できます。 • langgraph-cliのバージョン0.4.24がリリースされた • CLIのフォーマットが修正された • 3つのディレクトリにわたるpipグループの依存関係が更新された • リリース日は2023年4月22日 • GitHub上でのコミット情報が確認可能

Watch a guided walkthrough of an agent that pulls Friday metrics, creates charts, drafts the narrative, and delivers a ready-to-share business report.

Watch a guided walkthrough of an agent that screens vendors for sanctions, financial, and reputational risk, then turns the findings into a clear report.

Watch a guided walkthrough of an agent that qualifies inbound leads, drafts personalized follow-ups, and keeps the CRM up to date.

Watch a guided walkthrough of an agent that gathers feedback from Slack, support, and public channels, prioritizes what matters, and turns signals into weekly product action.

Introducing workspace agents in ChatGPT—shared agents that can handle complex tasks and long-running workflows across tools and teams. Agents are built to help with the kind of work that takes time, context, and follow-through: coordinating across tools like Slack and Linear, tracking progress, and moving tasks forward without needing constant supervision. Build an agent once, then share it across teams. Describe the job, and ChatGPT helps turn it into a working agent that can use your team’s best practices. Use agents for tasks like qualifying leads, routing feedback, reviewing requests, pulling reports, or researching vendors. Workspace agents are now available in research preview for ChatGPT Business, Enterprise, Edu, and Teachers plans. https://openai.com/index/introducing-workspace-agents-in-chatgpt/

10 months ago I argued against building multi-agent systems. Today, a narrower class works, where agents contribute intelligence while writes stay single-threaded. I want to share what we've learned building them at Cognition.

この記事では、Google Photosの新機能「Auto frame」について説明しています。この機能は、撮影後に写真の視点を再構成する新しいアプローチを提供します。従来の画像編集ツールでは解決できない、固定された視点からの問題を解決するために、機械学習と生成AIを活用しています。具体的には、2Dの写真を3Dシーンとして解釈し、カメラの位置を自動的に変更することで、新しい視点を提供します。このプロセスは、3Dシーンとカメラの推定、生成的なインペインティングとレタッチの2段階から成り立っています。最初の段階では、3Dポイントマップを用いて人間の体や顔を忠実に再構築し、次に古いカメラパラメータを用いて画像を生成します。最終的に、生成モデルを使用して、元のレンズでは捉えられなかった背景部分を補完します。 • Google Photosの新機能「Auto frame」により、撮影後に写真の視点を再構成できる。 • 機械学習と生成AIを使用して、固定された視点の問題を解決する。 • 2D写真を3Dシーンとして解釈し、カメラの位置を自動的に変更する。 • プロセスは3Dシーンとカメラの推定、生成的なインペインティングの2段階から成る。 • 3Dポイントマップを用いて人間の体や顔を忠実に再構築し、画像を生成する。 • 生成モデルを使用して、元のレンズでは捉えられなかった部分を補完する。

Big claims from Qwen about their latest open weight model: Qwen3.6-27B delivers flagship-level agentic coding performance, surpassing the previous-generation open-source flagship Qwen3.5-397B-A17B (397B total / 17B active MoE) across all …

Company-wise memory in Amazon Bedrock, powered by Amazon Neptune and Mem0, provides AI agents with persistent, company-specific context—enabling them to learn, adapt, and respond intelligently across multiple interactions. TrendMicro, one of the largest antivirus software companies in the world, developed the Trend’s Companion chatbot, so their customers can explore information through natural, conversational interactions

この記事は、Hugging FaceのTransformersライブラリのバージョン5.6.0のリリースに関するもので、新しいモデルの追加や機能の改善が紹介されています。新たに追加されたモデルには、OpenAI Privacy Filter、Qianfan-OCR、SAM3-LiteText、SLANetが含まれています。OpenAI Privacy Filterは、個人情報の検出とマスキングを行う双方向トークン分類モデルで、高スループットのデータサニタイズワークフローに適しています。Qianfan-OCRは、画像からテキストへの直接変換を行う文書インテリジェンスモデルで、複雑な文書に対しても効果的です。SAM3-LiteTextは、軽量なテキストエンコーダを使用してセグメンテーション性能を維持しつつ、パラメータを大幅に削減しています。SLANetは、文書や自然シーンにおけるテーブル構造認識に特化した軽量モデルです。さらに、いくつかの内部変更や機能強化も行われています。 • 新しいモデルの追加:OpenAI Privacy Filter、Qianfan-OCR、SAM3-LiteText、SLANet • OpenAI Privacy FilterはPII検出とマスキングを行うモデル • Qianfan-OCRは画像からテキストへの直接変換を行う • SAM3-LiteTextは軽量なテキストエンコーダを使用し、パラメータを88%削減 • SLANetはテーブル構造認識に特化したモデルで、精度と推論速度を向上させる • 内部の変更点として、Attentionモジュール内の関数呼び出し方法が変更された

A Blog post by NVIDIA on Hugging Face

OpenAI makes ChatGPT for Clinicians free for verified U.S. physicians, nurse practitioners, and pharmacists, supporting clinical care, documentation, and research.

The eighth generation of Google’s TPU includes two specialized chips that will power the future of AI.

この記事では、AIコーディングの信頼性を向上させるための決定論的ツールについて、Wes BosとScott Tolinskiが議論しています。具体的には、コード品質分析、リント戦略、ヘッドレスブラウザ、タスクワークフローを取り上げ、AIが推測するのではなく、保守可能で予測可能なコードを生成するためのより良いパターンを強制する方法を説明しています。使用されるツールには、fallow、knip、ESLint、StyleLint、Sentryなどが含まれ、これらを活用することでAIのコーディング精度を向上させることが可能です。 • AIコーディングの信頼性を向上させるための決定論的ツールの使用 • コード品質分析やリント戦略の重要性 • ヘッドレスブラウザやタスクワークフローの活用 • AIが推測するのではなく、保守可能なコードを生成するためのパターンの強制 • 使用される具体的なツール(fallow、knip、ESLint、StyleLint、Sentry)

Google’s new distributed architecture keeps AI training runs on track across distant data centers, with exceptional efficiency – even when hardware fails.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が向上し、エラーの削減が期待されます。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の期待 • 多くのプログラミング言語に対応

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が大幅に向上し、エラーの削減にも寄与します。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の効果 • 多言語対応で幅広い開発環境に適応

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。これにより、開発者はコーディングの効率を大幅に向上させることができ、エラーの削減や開発時間の短縮が期待されます。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した情報に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • コーディング効率の向上が期待される • エラー削減や開発時間短縮のメリット

As part of our continued collaboration with Anthropic, we had the opportunity to apply an early version of Claude Mythos Preview to Firefox. This week’s release of Firefox 150 includes …

On the same day as Claude Code's temporary will-they-won't-they $100/month kerfuffle (for the moment, they won't), here's the latest on GitHub Copilot pricing. Unlike Anthropic, GitHub put up an official …

Anthropic today quietly (as in silently, no announcement anywhere at all) updated their claude.com/pricing page (but not their Choosing a Claude plan page, which shows up first for me on …

A 7-step playbook for scoping, building, and shipping AI agent prototypes.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行う機能があります。これにより、開発の効率が大幅に向上し、エラーの削減にも寄与します。さらに、ツールは多くのプログラミング言語に対応しており、幅広い開発環境で利用可能です。 • AIを活用したコード自動生成ツールの紹介 • 自然言語での入力に基づくコード生成機能 • 既存コードへの改善提案機能 • 開発効率の向上とエラー削減の効果 • 多言語対応で幅広い開発環境に適応

What enterprises underestimate about building cloud agents.

OpenAI released ChatGPT Images 2.0 today, their latest image generation model. On the livestream Sam Altman said that the leap from gpt-image-1 to gpt-image-2 was equivalent to jumping from GPT-3 …

Gabriel Goh, Kenji Hata, Kiwhan Song, Alex Yu, Boyuan Chen, and Nithanth Kudige with host Sam Altman introduce and demo ChatGPT Images 2.

OpenAI researcher Ayaan Haque shows how capable ChatGPT Images 2.0 has become when Thinking is enabled. With the ability to research topics on the web, it can handle open-ended prompts and produce highly complex outputs

この記事は、GitHub上でのlangchain-openaiライブラリのバージョン1.1.16のリリースに関する情報を提供しています。このリリースでは、主にストリーミングにおけるprompt_cache_retentionのドリフトを許容する修正が行われました。これにより、ユーザーはストリーミング機能を使用する際の安定性が向上します。リリース日は2023年4月21日で、前のバージョン1.1.15からの変更点が記載されています。 • バージョン1.1.16のリリース日: 2023年4月21日 • ストリーミングにおけるprompt_cache_retentionのドリフトを許容する修正が行われた • ユーザーに対するストリーミング機能の安定性向上が期待される • 前のバージョン1.1.15からの変更点が含まれている

OpenAI researcher Jianfeng Wang explains how ChatGPT Images 2.0 can now follow highly detailed instruction in prompts, especially when it comes to spatial layouts and text rendering.

OpenAI researcher Yuguang Yang shows how, with Thinking selected, ChatGPT Images 2.0 can now follow long and complex prompts of over 1,000 words to create detailed, educational infographics. ChatGPT can now also transform uploaded PDFs into complete slides for presentations or polished infographics as PDF outputs.

OpenAI researcher Boyuan Chen demonstrates ChatGPT Images 2.0’s ability to render dense text across multiple languages while keeping stylistic choices intact. While text rendering in Latin-based languages has already been strong, the model has now expanded to handle a much wider range of languages.

OpenAI researcher Dibya Bhattacharjee shows the variety of aspect ratios you can prompt with ChatGPT Images 2.0, plus the jump in maximum resolution – from 1k in to now 2k resolution, or even higher when using our API.

Imagine what you make. Unlock a new form of storytelling with ChatGPT Images 2.0. Every frame was generated with ChatGPT Images.

Today, we're excited to announce Claude Cowork in Amazon Bedrock. You can now run Cowork and Claude Code Desktop through Amazon Bedrock, directly or using an LLM gateway. In this post, we walk through how Claude Cowork integrates with Amazon Bedrock and show an example of how knowledge workers use it in practice.

A new era of image generation. Video made with ChatGPT Images.

Evaluate AI agents effectively: learn offline vs. online testing, key metrics, and methods like deterministic checks, LLM-as-a-judge, and human review to improve performance and reliability.

In this post, we show how to combine DVC (Data Version Control), Amazon SageMaker AI, and Amazon SageMaker AI MLflow Apps to build end-to-end ML model lineage. We walk through two deployable patterns — dataset-level lineage and record-level lineage — that you can run in your own AWS account using the companion notebooks.

ReasoningBankは、エージェントが成功と失敗の経験から一般化可能な推論戦略を抽出し、デプロイ後も継続的に学習できるようにする新しいエージェントメモリフレームワークです。従来のエージェントは、メモリ機構なしで新しいタスクに取り組むと、同じ戦略的エラーを繰り返し、貴重な洞察を失ってしまいます。ReasoningBankは、成功体験と失敗体験の両方から有用な洞察を抽出し、テスト時の自己進化を可能にします。具体的には、エージェントはReasoningBankから関連するメモリを引き出し、環境と相互作用し、得られた結果を自己評価します。このプロセスにより、エージェントは成功の洞察や失敗の反省を抽出し、戦略的なガードレールを構築します。ReasoningBankは、ウェブブラウジングやソフトウェアエンジニアリングのベンチマークで評価され、エージェントの効果と効率を向上させることが確認されています。 • エージェントが成功と失敗の経験から学ぶことができないという課題を解決する。 • ReasoningBankは、成功体験と失敗体験の両方から洞察を抽出する新しいメモリフレームワークを提案。 • エージェントは、ReasoningBankからメモリを引き出し、環境と相互作用し、結果を自己評価する。 • 失敗からの教訓を抽出し、戦略的ガードレールを構築することで、エージェントの効果と効率を向上させる。 • ReasoningBankは、ウェブブラウジングやソフトウェアエンジニアリングのベンチマークで高い成功率と効率を示す。

AI agents are already too human. Not in the romantic sense, not because they love or fear or dream, but in the more banal and frustrating one. The current implementations …

I firmly approve of Steve Cosman's efforts to pollute the training set of pelicans riding bicycles. (To be fair, most of the examples I've published count as poisoning too.)

Google DeepMind is partnering with leading consultancies to bridge the AI adoption gap and drive agentic transformation with frontier models and expert research.

この記事は、langgraphのバージョン1.1.9のリリースに関する情報を提供しています。このリリースでは、バージョン1.1.8からの変更点として、ReplayStateがサブグラフに伝播しないように修正されたことが挙げられています。また、ストリームハンドラーにおける不要な変更が元に戻されたことも記載されています。これにより、langgraphの動作が改善され、より安定した使用が可能になることが期待されます。 • langgraphのバージョン1.1.9がリリースされた • ReplayStateがサブグラフに伝播しないように修正された • ストリームハンドラーにおける不要な変更が元に戻された • これにより、langgraphの動作が改善されることが期待される

A Blog post by Technology Innovation Institute on Hugging Face

You can now access GPT Image 2 on Vercel's AI Gateway with no markup and no other provider accounts required.

A Blog post by NVIDIA on Hugging Face

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコメントや関数名に基づいて、AIが適切なコードを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。これにより、開発者は生産性を向上させ、エラーを減少させることが期待されます。さらに、ユーザーインターフェースも直感的で使いやすく設計されています。 • AIを活用したコード自動生成ツールの紹介 • 開発者が入力した内容に基づいてコードを提案する機能 • JavaScriptやPythonなど多くの言語に対応 • 生産性向上とエラー削減が期待される • 直感的で使いやすいユーザーインターフェース

GPT‑Rosalind and the Life Sciences Research Plugin for Codex help researchers connect evidence, databases, and scientific tools to plan stronger follow-up experiments. Learn more: https://openai.com/index/introducing-gpt-rosalind/

GPT‑Rosalind in Codex helps scientists move from raw scientific inputs to evidence-backed hypotheses, analysis, and research decisions across discovery workflows. Learn more: https://openai.com/index/introducing-gpt-rosalind/

この記事は、GitHub上でのlangchain-openaiライブラリのバージョン1.1.15のリリースに関する情報を提供しています。このリリースでは、いくつかのバグ修正が行われました。具体的には、ストリーミング中の辞書型レスポンスアイテムに対応する修正や、モデル名からAzureチャットプロファイルを推測する機能の修正が含まれています。また、モデルプロファイルデータの更新も行われています。これにより、ユーザーはよりスムーズにライブラリを利用できるようになります。 • バージョン1.1.15のリリース情報 • ストリーミング中の辞書型レスポンスアイテムへの対応 • Azureチャットプロファイルの推測機能の修正 • モデルプロファイルデータの更新 • ユーザー体験の向上

Today, we are thrilled to announce the availability of G7e instances powered by NVIDIA RTX PRO 6000 Blackwell Server Edition GPUs on Amazon SageMaker AI. You can provision nodes with 1, 2, 4, and 8 RTX PRO 6000 GPU instances, with each GPU providing 96 GB of GDDR7 memory. This launch provides the capability to use a single-node GPU, G7e.2xlarge instance to host powerful open source foundation models (FMs) like GPT-OSS-120B, Nemotron-3-Super-120B-A12B (NVFP4 variant), and Qwen3.5-35B-A3B, offering organizations a cost-effective and high-performing option.

LLM plugin for models hosted by OpenRouter

You can use ToolSimulator, an LLM-powered tool simulation framework within Strands Evals, to thoroughly and safely test AI agents that rely on external tools, at scale. Instead of risking live API calls that expose personally identifiable information (PII), trigger unintended actions, or settling for static mocks that break with multi-turn workflows, you can use ToolSimulator's large language model (LLM)-powered simulations to validate your agents. Available today as part of the Strands Evals Software Development Kit (SDK), ToolSimulator helps you catch integration bugs early, test edge cases comprehensively, and ship production-ready agents with confidence.

In this post, we'll show you how to build a complete omnichannel ordering system using Amazon Bedrock AgentCore, an agentic platform, to build, deploy, and operate highly effective AI agents securely at scale using any framework and foundation model and Amazon Nova 2 Sonic.

You can now access Moonshot AI's Kimi K2.6 on Vercel's AI Gateway with no markup and no other provider accounts required.

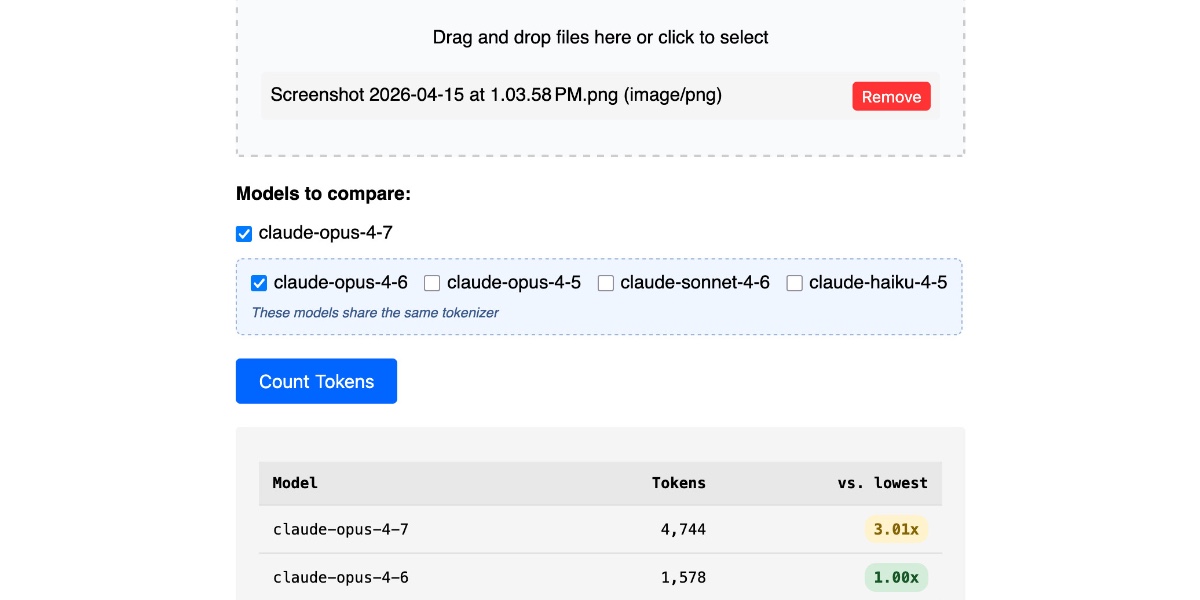

I upgraded my Claude Token Counter tool to add the ability to run the same count against different models in order to compare them. As far as I can tell …

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や補完を行います。具体的には、開発者が入力したコードの意図を理解し、適切なコードスニペットを提案する機能があります。また、ツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの使用が推奨されています。さらに、ユーザーからのフィードバックを基に継続的に改善される点も強調されています。 • AI技術を活用した新しい開発ツールの紹介 • コードの自動生成や補完機能を提供 • 開発者の意図を理解して適切なコードを提案 • 多くのプログラミング言語に対応、特にJavaScriptとPythonが推奨 • ユーザーからのフィードバックを基に継続的に改善される

Matt Webb thinks headless services are about to become much more common: Why? Because using personal AIs is a better experience for users than using services directly (honestly); and headless …

The Top AI Papers of the Week (April 13 - April 19)

この記事では、AIプロンプトの再現性を向上させるための自動チューニング手法について説明しています。プロンプトを作成した直後は、書き手の主観が強く、他のAIセッションで使用すると再現性が失われることが多いです。この問題を解決するために、別のAIにプロンプトを実行させ、その結果を評価させることで、プロンプトを段階的に洗練させるアプローチが提案されています。具体的には、Claude CodeのTask toolを使用して、別のサブエージェントを起動し、実行結果をレポートさせる方法が紹介されています。評価は自己申告と指示側計測の2面から行い、要件チェックリストを用いて成功判定を行います。最終的に、プロンプトの品質を向上させるための反復的な修正プロセスが強調されています。 • プロンプトの再現性が失われる問題を解決する手法を提案 • 別のAIにプロンプトを実行させ、評価を行うことで洗練させる • Claude CodeのTask toolを使用して別サブエージェントを起動する • 評価は自己申告と指示側計測の2面から行う • 要件チェックリストを用いて成功判定を行う • 反復的な修正プロセスがプロンプトの品質向上に寄与する

Anthropic are the only major AI lab to publish the system prompts for their user-facing chat systems. Their system prompt archive now dates all the way back to Claude 3 …

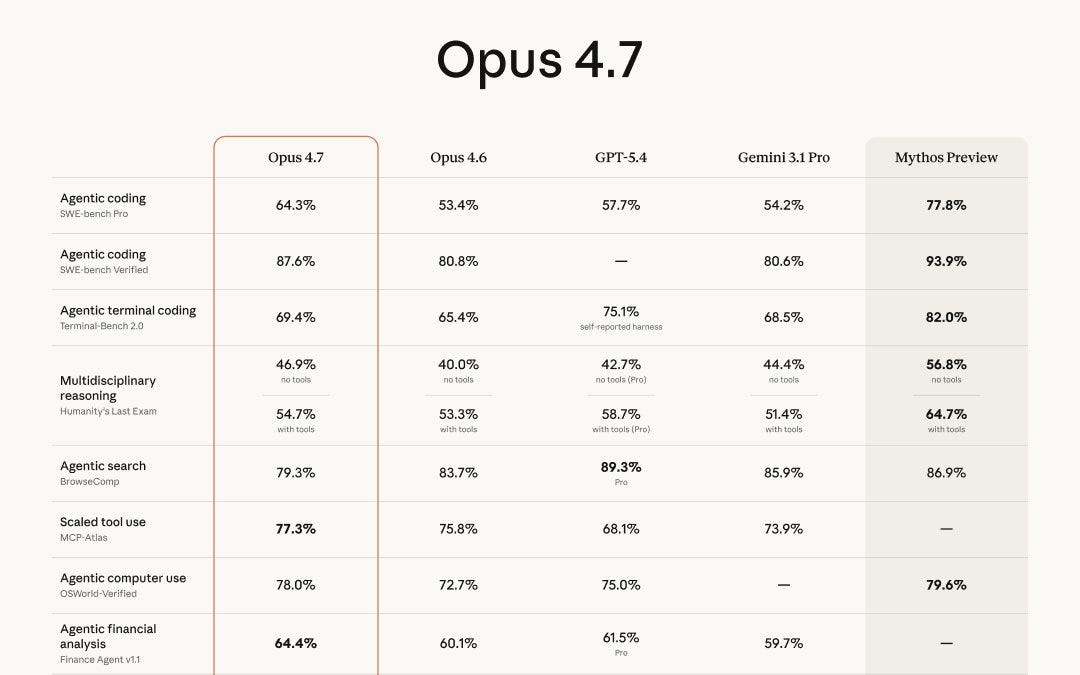

Claude Opus 4.7, Codex Everywhere, Claude Design, Windsurf 2.0, Qwen3.6-35B-A3B, AiScientist, and More

Anthropic's published system prompt history for Claude is transformed into a git-based exploration tool, breaking up the monolithic markdown source into granular files and timestamped commits. By structuring extracted prompts …

This year’s PyCon US is coming up next month from May 13th to May 19th, with the core conference talks from Friday 15th to Sunday 17th and tutorial and sprint …

In this post, we share how Amazon Bedrock's granular cost attribution works and walk through example cost tracking scenarios.

この記事は、GitHub上で公開されているlanggraphのバージョン1.1.8のリリースに関する情報を提供しています。このリリースでは、前のバージョン1.1.7からの変更点として、OTel(OpenTelemetry)計測を妨げる厳密なadd_handler型チェックを削除する修正が含まれています。また、prebuiltバージョン1.0.10とCLIバージョン0.4.23も同時にリリースされています。これにより、ユーザーはよりスムーズにOTelを利用できるようになります。 • OTel計測を妨げる厳密なadd_handler型チェックを削除した • prebuiltバージョン1.0.10がリリースされた • CLIバージョン0.4.23がリリースされた • ユーザーはOTelをよりスムーズに利用できるようになる

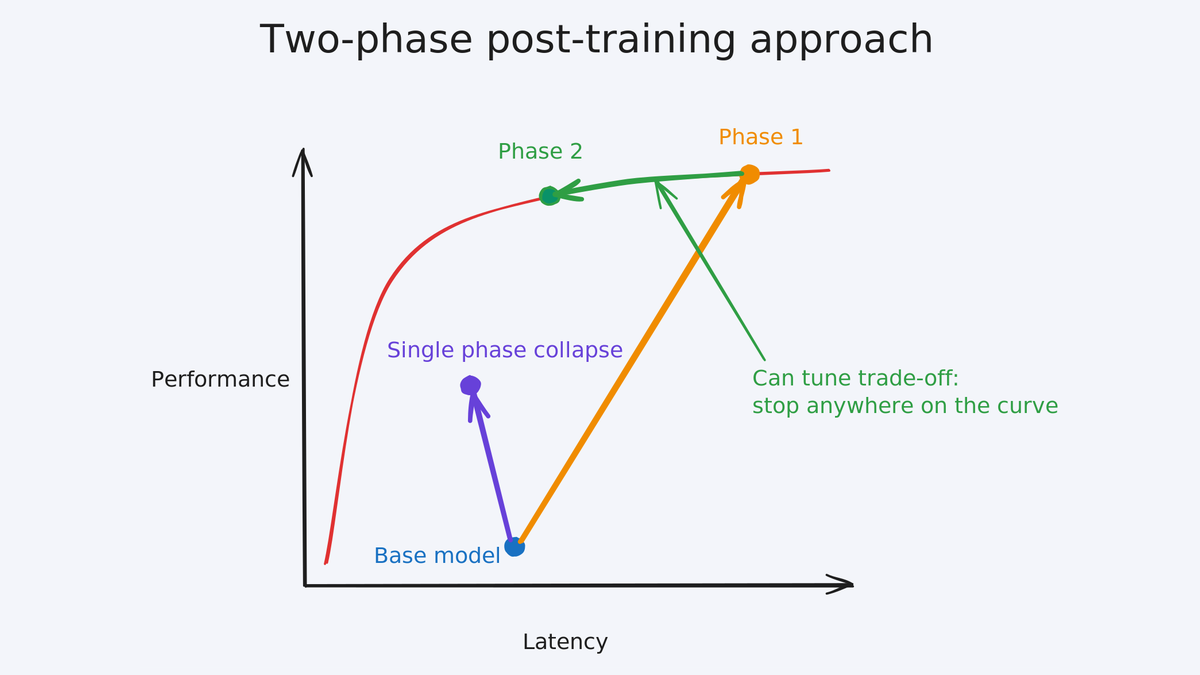

In this post, we show you how to use Model Distillation, a model customization technique on Amazon Bedrock, to transfer routing intelligence from a large teacher model (Amazon Nova Premier) into a much smaller student model (Amazon Nova Micro). This approach cuts inference cost by over 95% and reduces latency by 50% while maintaining the nuanced routing quality that the task demands.

In this post, we show you how to build a video semantic search solution on Amazon Bedrock using Nova Multimodal Embeddings that intelligently understands user intent and retrieves accurate video results across all signal types simultaneously. We also share a reference implementation you can deploy and explore with your own content.

This hands-on guide walks through every step of fine-tuning an Amazon Nova model with the Amazon Nova Forge SDK, from data preparation to training with data mixing to evaluation, giving you a repeatable playbook you can adapt to your own use case. This is the second part in our Nova Forge SDK series, building on the SDK introduction and first part, which covered kicking off customization experiments.

In this post, we share how AWS Marketing’s Technology, AI, and Analytics (TAA) team worked with Gradial to build an agentic AI solution on Amazon Bedrock for accelerating content publishing workflows.

A Blog post by NVIDIA on Hugging Face

この記事では、Metaが内部の推薦およびランキング作業における効果的なトレーニング時間(ETT%)を最適化する方法について説明しています。ETT%は、全体のエンドツーエンド(E2E)時間の中で生産的なトレーニングに費やされる時間の割合を示し、効率性の向上に向けた優先順位付けを助けます。Metaは、PyTorchを使用してモデルをトレーニングする際の経験に基づき、オープンソースで実装された改善策(TorchRecのシャーディング計画やPyTorch 2のコンパイル最適化など)と、Meta特有の改善策(チェックポイントやモデルの公開など)を共有しています。ETT%の向上を目指し、過去数年間で40以上の新技術を開発し、トレーニングの開始時間を短縮するための取り組みを行っています。 • Metaは効果的なトレーニング時間(ETT%)を定義し、全体のE2E時間の中で生産的なトレーニングに費やされる時間の割合を示す。 • ETT%を向上させるために、システムの最適化視点からアイダレスや失敗を測定することに焦点を当てている。 • トレーニングサイクルの各段階(スケジューリング時間、ハードウェアセットアップ時間、PT2コンパイル時間など)を定義し、改善のための指標を提供している。 • Metaは40以上の新技術を開発し、ETT%の向上に向けた取り組みを行っている。 • オープンソースでの改善策とMeta特有の改善策を共有し、業界全体のボトルネックに対処する。

A Blog post by NVIDIA on Hugging Face

この記事は、langgraphのバージョン1.1.7のリリースに関する情報を提供しています。このリリースでは、特にノードを中断する際の時間旅行機能の修正が行われました。また、依存関係としてlangsmithのバージョンが0.6.4から0.7.31に更新されています。リリースはGitHub上で行われ、コミットはGitHubの検証済み署名で作成されています。 • ノードを中断する際の時間旅行機能の修正 • 依存関係としてlangsmithのバージョンを0.6.4から0.7.31に更新 • リリースはGitHub上で行われ、検証済み署名が付与されている

この記事は、Langchainのコアライブラリのバージョン1.3.0のリリースに関する情報を提供しています。このリリースでは、いくつかの重要な変更が行われました。具体的には、チャットモデルとLLM呼び出しパラメータをトレース可能なメタデータに追加し、ストリーミングメタデータの互換性を保つためのチェックポイントの動作を維持しました。また、SSRFポリシーにおけるクラウドメタデータのIPアドレスとリンクローカル範囲を復元する修正も含まれています。さらに、OpenAIのAPIレスポンスにおいて、タイプキーなしのコンテンツブロックを処理するための修正が行われました。これらの変更により、パフォーマンスの向上や互換性の維持が図られています。 • Langchainコアライブラリのバージョン1.3.0がリリースされた。 • チャットモデルとLLM呼び出しパラメータがトレース可能なメタデータに追加された。 • ストリーミングメタデータの互換性を保つためのチェックポイントの動作が維持された。 • クラウドメタデータのIPアドレスとリンクローカル範囲がSSRFポリシーで復元された。 • OpenAIのAPIレスポンスにおいて、タイプキーなしのコンテンツブロックを処理する修正が行われた。

この記事は、LangchainのAnthropicライブラリのバージョン1.4.1のリリースに関する情報を提供しています。このリリースでは、いくつかの重要な修正と新機能が追加されました。具体的には、nullの暗号化コンテンツを圧縮ブロックから削除する修正、Opus 4.7機能のサポート、適応思考モードのサポートが含まれています。また、依存関係の更新やドキュメント内の誤字修正も行われています。これにより、ライブラリの安定性と機能性が向上しています。 • LangchainのAnthropicライブラリのバージョン1.4.1がリリースされた。 • nullの暗号化コンテンツを圧縮ブロックから削除する修正が行われた。 • Opus 4.7機能のサポートが追加された。 • 適応思考モードのサポートが新たに実装された。 • 依存関係の更新やドキュメント内の誤字修正が行われた。

What's new in Arcjet (2026-04-17). MCP server, a new AI coding agent plugin for Claude Code and Cursor, and new weekly security briefings via email.

See how Zo Computer used Vercel AI Gateway and AI SDK to cut retry rates 20x, raise chat success to 99.93%, reduce P99 latency by 38%, and add new model support in under a minute while scaling its personal AI cloud platform.

この記事は、Chromaのバージョン1.5.8のリリースに関する情報を提供しています。このリリースでは、シャーディングに対応したmaterialize_logsの改善や、各シャードごとのリトライ機能の追加、シャーディングコレクションのためのseal operatorの統合などが行われました。また、管理RPCのタイムアウトを設定可能にする機能や、CLIコマンドにI/O抽象化を追加するなどの改善も含まれています。バグ修正としては、最近のログスパナーマイグレーションの冪等性を確保するための修正が行われました。新しい機能や改善点が多く含まれており、開発者にとって有用なアップデートとなっています。 • シャーディングに対応したmaterialize_logsの改善 • 各シャードごとのリトライ機能の追加 • シャーディングコレクションのためのseal operatorの統合 • 管理RPCのタイムアウト設定機能の追加 • CLIコマンドにI/O抽象化を追加 • 最近のログスパナーマイグレーションの冪等性を確保するバグ修正

LLM access to models by Anthropic, including the Claude series

What does it take to build AI systems that can actually help scientists? Research lead Joy Jiao and product lead Yunyun Wang discuss how OpenAI is developing models for life sciences and what responsible deployment means in a field with real biosecurity stakes. They explore how AI is already improving research workflows and where it could lead in drug discovery and more autonomous labs — including why a future with less pipetting sounds pretty good to most scientists. Chapters 0:39 Introducing the Life Sciences model series 3:47 Joy’s path into life sciences 5:00 Autonomous lab with Ginkgo Bioworks 7:27 Yunyun’s path into life sciences 8:12 OpenAI’s life sciences work 9:48 Biorisk, access, and safeguards 15:43 What models can do in the lab 17:51 Building scientific infrastructure 20:14 Why compute matters for science 24:54 Where are we in 6-12 months? 29:51 Scientific adoption and skepticism 33:17 Advice for students and researchers 40:27 Where are we in 10 years?

この記事は、langgraph-cliのバージョン0.4.22のリリースに関する情報を提供しています。主な変更点として、CLIのデプロイソースの追跡開始、依存関係の更新が含まれています。具体的には、langsmithやlangchain-coreのバージョンがそれぞれ更新され、複数のディレクトリでのuvグループのバンプも行われています。これにより、CLIの機能や安定性が向上することが期待されます。 • langgraph-cliのバージョン0.4.22がリリースされた • CLIデプロイソースの追跡が開始された • langsmithのバージョンが0.7.26から0.7.31に更新された • langchain-coreのバージョンが1.2.27から1.2.28に更新された • 複数のディレクトリでuvグループが更新された

In this post, we demonstrate two approaches to fine-tune Amazon Nova Micro for custom SQL dialect generation to deliver both cost efficiency and production ready performance.

Online retailers face a persistent challenge: shoppers struggle to determine the fit and look when ordering online, leading to increased returns and decreased purchase confidence. The cost? Lost revenue, operational overhead, and customer frustration. Meanwhile, consumers increasingly expect immersive, interactive shopping experiences that bridge the gap between online and in-store retail. Retailers implementing virtual try-on […]

In this post, you'll learn why probabilistic AI validation falls short in regulated industries and how Automated Reasoning checks use formal verification to deliver mathematically proven results. You'll also see how customers across six industries use this technology to produce formally verified, auditable AI outputs, and how to get started.

For anyone who has been taking my pelican riding a bicycle benchmark seriously as a robust way to test models, here are pelicans from this morning’s two big model releases—Qwen3.6-35B-A3B …

Codex can now use apps on your Mac, connect to more of your tools, create images, learn from previous actions, remember how you like to work, and take on ongoing and repeatable tasks.

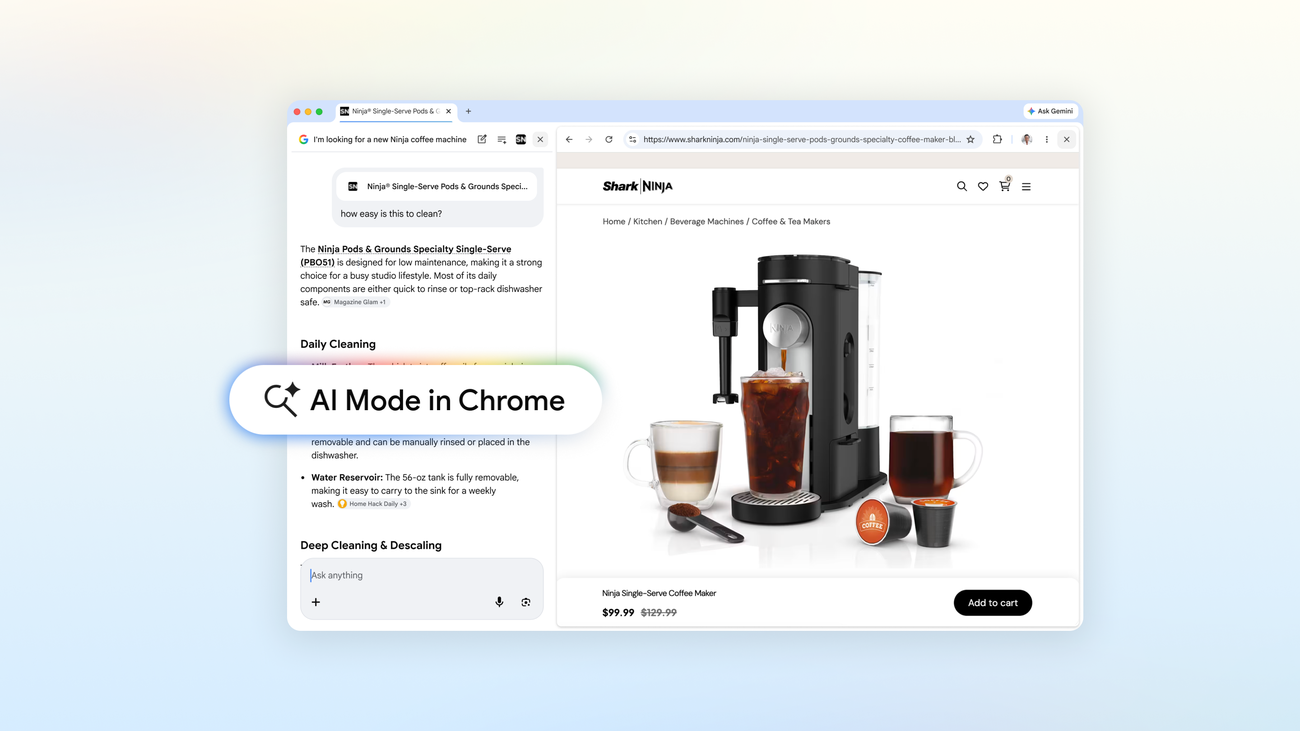

Today’s upgrades for AI Mode in Chrome transform how you interact with the web

Nano Banana 2 now uses your personal context and Google Photos to create images that reflect your unique life.

AI observability checklist for 2026: gain visibility, control AI agents, manage risks, and scale trusted enterprise AI.

この記事は、langchain-openaiのバージョン1.1.14のリリースに関する情報を提供しています。このリリースでは、主に以下の変更が行われました。まず、画像トークンカウントのためにSSRF安全なトランスポートを使用する修正が加えられました。また、依存関係としてpytestが9.0.3にアップグレードされ、langsmithが0.6.3から0.7.31に、pillowが12.1.1から12.2.0にそれぞれバージョンアップされました。これらの変更は、パフォーマンスやセキュリティの向上を目的としています。 • 画像トークンカウントのためにSSRF安全なトランスポートを使用する修正が行われた。 • pytestが9.0.3にアップグレードされた。 • langsmithが0.6.3から0.7.31にバージョンアップされた。 • pillowが12.1.1から12.2.0にバージョンアップされた。 • これらの変更はパフォーマンスやセキュリティの向上を目的としている。

この記事では、特化型AIに必要なデータの不足に対処するためのフレームワーク「Simula」を紹介しています。Simulaは、合成データ生成をデータセットレベルのメカニズム設計として再定義し、ファーストプリンシプルからデータセットを構築することで、カバレッジ、複雑さ、品質を細かく制御できるようにします。これにより、プライバシーに敏感な領域やデータが不足している領域において、スケーラブルなデータ生成が可能になります。従来の合成データ生成方法は、手動のプロンプトや進化的アルゴリズムに依存しており、スケーラビリティや説明可能性に制限がありました。Simulaは、データ生成プロセスを明確に制御可能な軸に分解し、グローバルな多様性を確保するための戦略を定義します。 • 特化型AIに必要なデータの不足に対処するためのフレームワーク「Simula」を提案 • Simulaは合成データ生成をデータセットレベルのメカニズム設計として再定義 • ファーストプリンシプルからデータセットを構築し、カバレッジ、複雑さ、品質を制御可能 • 従来の合成データ生成方法は手動プロンプトや進化的アルゴリズムに依存し、スケーラビリティに制限があった • Simulaはデータ生成プロセスを明確に制御可能な軸に分解し、グローバルな多様性を確保するための戦略を定義

この記事は、langchain-text-splittersのバージョン1.1.2のリリースに関するもので、主に以下の変更点が含まれています。まず、URLからのテキスト分割において、SSRF(Server-Side Request Forgery)に安全なトランスポートを使用するように変更されました。また、RecursiveJsonSplitterにおいて空の辞書値によるデータ損失を防ぐ修正が行われました。さらに、Python 3.14でのspacyテストのサポートが追加され、依存関係のバージョンがいくつか更新されました。これにより、全体的なパフォーマンスと安定性が向上しています。 • URLからのテキスト分割においてSSRF安全なトランスポートを使用するように変更 • RecursiveJsonSplitterでの空の辞書値によるデータ損失を防ぐ修正 • Python 3.14でのspacyテストのサポート追加 • 依存関係のバージョン更新によりパフォーマンス向上 • 全体的な安定性の向上

この記事は、GitHub上でのlangchain-coreのバージョン1.2.31のリリースに関する情報を提供しています。このリリースは、バージョン1.2.30からの変更点として、ポート36816をv1.2に移行したことが含まれています。リリースは2023年4月16日に行われ、GitHubの検証済み署名で作成されています。記事には、リリースに関連するアセットや通知設定の変更に関する情報も含まれていますが、具体的な技術的な詳細や実装方法については言及されていません。 • langchain-coreのバージョン1.2.31がリリースされた • 前のバージョン1.2.30からの変更点はポート36816をv1.2に移行したこと • リリース日は2023年4月16日 • GitHubの検証済み署名で作成された • 具体的な技術的な詳細や実装方法については記載がない

Void makes Cloudflare deployment invisible with Alexander Lichter

apm は Microsoft が開発した AI エージェント向けパッケージマネージャーです。npm や pip のように依存関係を解決しながら、エージェントのスキルや MCP をパッケージ化して管理・共有できます。この記事では apm の基本的な使い方を紹介します。

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者がコードを書く際にAIの支援を受けることができるもので、特に生成AIを利用してコードの自動生成や修正を行うことができます。具体的には、開発者が意図する機能を自然言語で入力すると、ツールがそれに基づいてコードを生成します。また、既存のコードに対しても改善提案を行うことができ、開発効率を大幅に向上させることが期待されています。さらに、このツールは多くのプログラミング言語に対応しており、特にJavaScriptやPythonでの利用が推奨されています。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での入力に基づくコードの自動生成機能 • 既存コードへの改善提案機能 • 開発効率の向上が期待される • JavaScriptやPythonに特に対応している

You can now access Claude Opus 4.7 on Vercel's AI Gateway with no markup and no other provider accounts required.

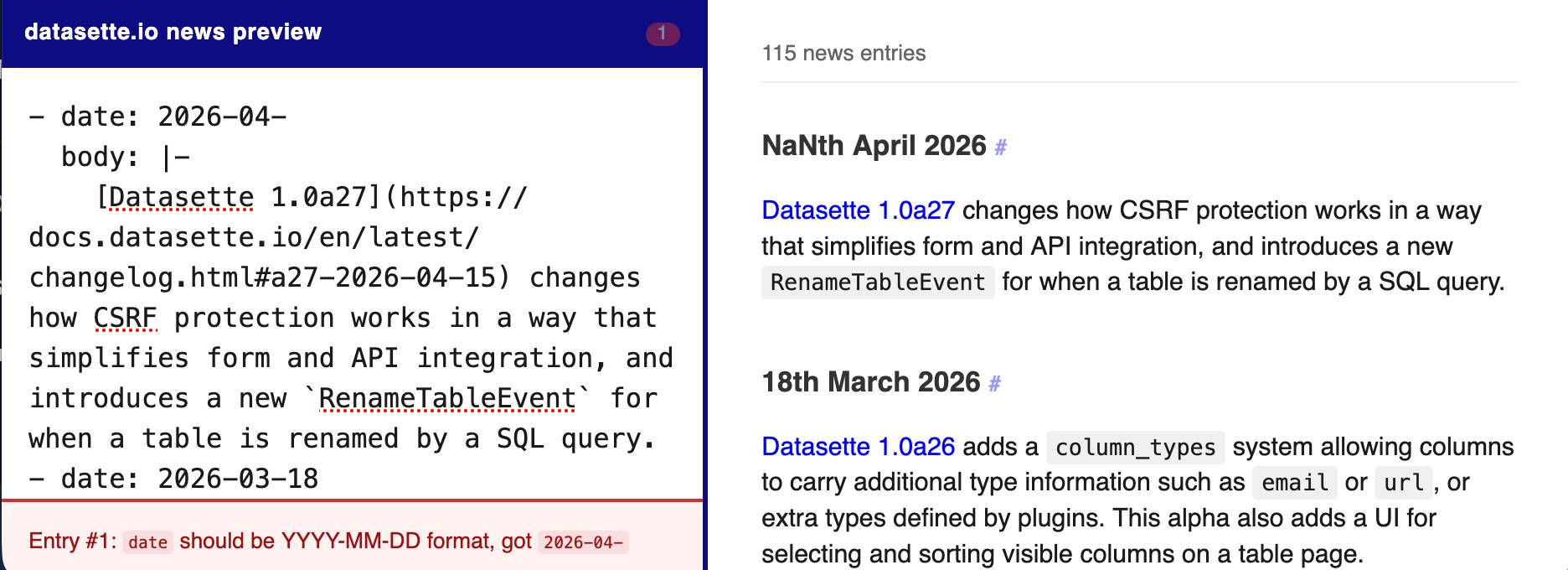

datasette.io news preview

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

Multi-agent observability is exponentially harder than single-agent monitoring. Here's how to trace, debug, and monitor AI systems where agents orchestrate other agents.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

We’re on a journey to advance and democratize artificial intelligence through open source and open science.

この記事では、最新のAI技術を活用した新しい開発ツールについて説明しています。このツールは、開発者が効率的にコードを書くための支援を行い、特に生成AIを利用した機能が強調されています。具体的には、自然言語での指示を受けてコードを生成する能力や、既存のコードの改善提案を行う機能が含まれています。また、ユーザーインターフェースが直感的で使いやすく設計されており、開発者がすぐに利用できるようになっています。さらに、ツールの導入によって開発プロセスの効率が向上し、エラーの削減が期待できると述べられています。 • AI技術を活用した新しい開発ツールの紹介 • 自然言語での指示に基づくコード生成機能 • 既存コードの改善提案機能 • 直感的で使いやすいユーザーインターフェース • 開発プロセスの効率向上とエラー削減の期待

Local agents make you faster. Cloud agents do the work while you're not there.

この記事は、GitHub上のlangchain-aiプロジェクトにおけるlanggraph-checkpointのバージョン4.0.2のリリースに関する情報を提供しています。このリリースでは、主にセキュリティに関するドキュメントの更新や、依存関係のバージョンアップが行われています。具体的には、LANGGRAPH_STRICT_MSGPACKに関するドキュメントが追加され、pytest、langchain-core、pygments、requests、orjsonなどのライブラリがそれぞれ新しいバージョンに更新されています。また、チェックポイントバッチにタスクを追加しないようにする修正も含まれています。 • langgraph-checkpointのバージョン4.0.2がリリースされた • セキュリティに関するドキュメントが更新された • 依存関係としてpytest、langchain-core、pygments、requests、orjsonがバージョンアップされた • チェックポイントバッチにタスクを追加しない修正が行われた

この記事は、GitHub上でのlangchain-coreのバージョン1.2.30のリリースに関する情報を提供しています。このリリースは2023年4月15日に行われ、主にプライベートなSSRFユーティリティの強化が含まれています。具体的には、ポート36768に関連する変更が行われました。これにより、セキュリティが向上し、より安全な操作が可能になります。リリースノートには、前のバージョン1.2.29からの変更点が記載されています。 • プライベートなSSRFユーティリティの強化が行われた • ポート36768に関連する変更が含まれている • セキュリティの向上が期待される • リリースは2023年4月15日に行われた • 前のバージョン1.2.29からの変更点が記載されている

Fix it like a pro with ChatGPT Director : Abhinav Pratiman DOP : Tassaduq Hussain Production House : Early Man Film Creative agency: Hue & Why

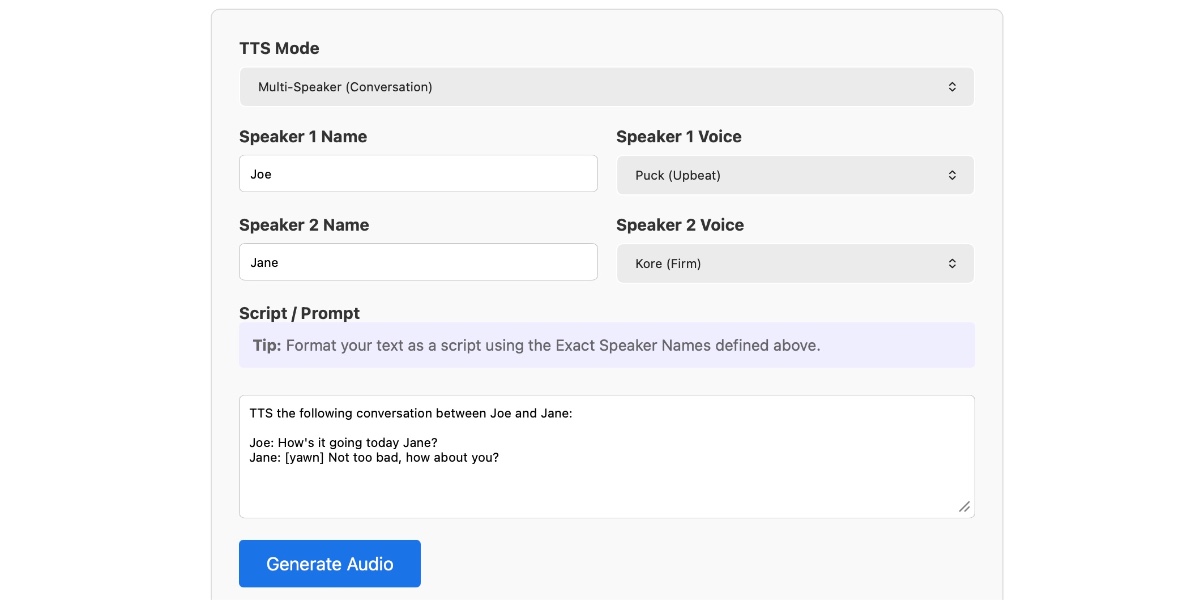

Google released Gemini 3.1 Flash TTS today, a new text-to-speech model that can be directed using prompts. It's presented via the standard Gemini API using gemini-3.1-flash-tts-preview as the model ID, …

Gemini 3.1 Flash TTS

Gemini 3.1 Flash TTS is now available across Google products.

I think we will see some people employed (though perhaps not explicitly) as meat shields: people who are accountable for ML systems under their supervision. The accountability may be purely …

In this post, you will learn how speculative decoding works and why it helps reduce cost per generated token on AWS Trainium2.

This post is cowritten by Renata Salvador Grande, Gabriel Bueno and Paulo Laurentys at Rede Mater Dei de Saúde. The growing adoption of multi-agent AI systems is redefining critical operations in healthcare. In large hospital networks, where thousands of decisions directly impact cash flow, service delivery times, and the risk of claim denials, the ability […]

Explore how Microsoft is advancing Frontier Transformation across industries, helping organizations move from AI experimentation to real world impact.

Gemini 3.1 Flash TTS is now available across Google products.

A Blog post by IBM Research on Hugging Face

Ship more with local and cloud agents working together.

OpenAI updates the Agents SDK with native sandbox execution and a model-native harness, helping developers build secure, long-running agents across files and tools.

You can now access Seedance 2.0 Video Generation via Vercel's AI Gateway with no other provider accounts required.

この記事は、langchain-openaiライブラリのバージョン1.1.13のリリースに関する情報を提供しています。このリリースでは、OpenAI APIのレスポンスにおいて、タイプキーがないコンテンツブロックを処理する修正が行われました。また、モデルプロファイルデータの更新や、ドキュメント内の誤字修正も含まれています。さらに、OpenAIファイル入力のためのプレースホルダーファイル名の補完機能が追加され、ユーザー提供のUser-AgentがAzureのデフォルトを上書きできるようになりました。これにより、APIの使用における柔軟性が向上しています。 • OpenAI APIのレスポンスにおいて、タイプキーがないコンテンツブロックを処理する修正が行われた。 • モデルプロファイルデータの更新が行われた。 • ドキュメント内の誤字が修正された。 • OpenAIファイル入力のためのプレースホルダーファイル名の補完機能が追加された。 • ユーザー提供のUser-AgentがAzureのデフォルトを上書きできるようになった。

The conversation about AI and coding work is full of highs. These models are incredible! I’m so productive. I’m not blocked by a lack of knowledge in certain areas like I used to get. I’m making projects I never would have gotten around to making. I’m having fun with code for the first time in […]

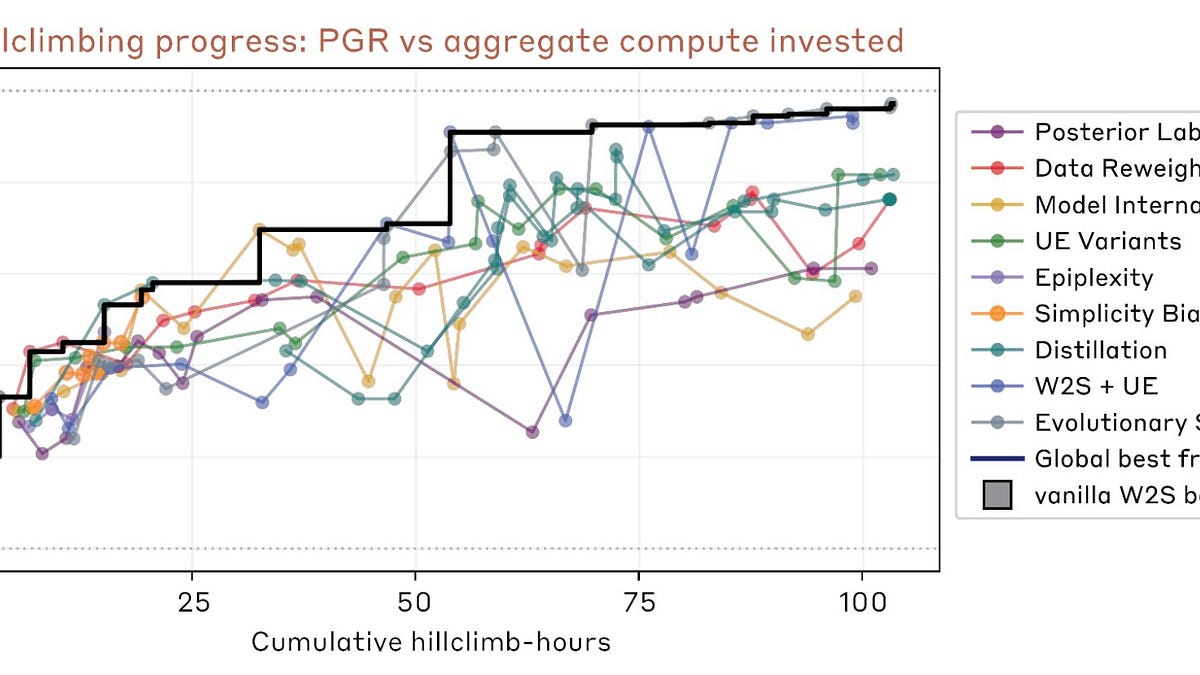

Smaller specialized models can match or beat frontier generalists on the tasks they're trained for. Working with Applied Compute, we RL-trained SWE-check, a bug detection model that matches Opus 4.6 on our internal evals while running ~10x faster.

OpenAI's answer to Claude Mythos appears to be a new model called GPT-5.4-Cyber: In preparation for increasingly more capable models from OpenAI over the next few months, we are fine-tuning …

この記事は、GitHub上でのlangchain-coreのバージョン1.2.29のリリースに関する情報を提供しています。このリリースは2023年4月14日に行われ、前のバージョン1.2.28からの変更点が含まれています。具体的には、コミット479a255が作成され、GitHubの検証済み署名で署名されています。リリースノートには、バージョン1.2.29における変更点や修正が記載されていますが、詳細な内容は示されていません。 • GitHubでのlangchain-coreのバージョン1.2.29のリリース情報 • リリース日は2023年4月14日 • 前のバージョン1.2.28からの変更点が含まれている • コミット479a255が作成され、GitHubの検証済み署名で署名されている • 具体的な変更内容はリリースノートに記載されているが、詳細は不明

The UK's AI Safety Institute recently published Our evaluation of Claude Mythos Preview’s cyber capabilities, their own independent analysis of Claude Mythos which backs up Anthropic's claims that it is …

In this post, we introduce the Generative AI Path-to-Value (P2V) framework, a structured approach to help you move generative AI initiatives from concept to production and sustained value creation.

We're excited to announce the launch of Amazon SageMaker JumpStart optimized deployments. SageMaker JumpStart improved deployments address the need for rich and straightforward deployment customization on SageMaker JumpStart by offering pre-defined deployment configurations, designed for specific use cases. Customers maintain the same level of visibility into the details of their proposed deployments, but now deployments are optimized for their specific use case and performance constraint.

この記事は、GitHub上で公開されているlanggraphのバージョン1.1.7a2のリリースに関する情報を提供しています。このリリースでは、依存関係の更新としてpytestが9.0.2から9.0.3にバージョンアップされ、トレーシング目的のメタデータの一部を渡すことが可能になりました。また、設定からassistant_idをメタデータではなく構成から取得するように修正されています。これにより、langgraphの機能が向上し、より柔軟な設定が可能になっています。 • 依存関係の更新としてpytestが9.0.2から9.0.3にバージョンアップされた。 • トレーシング目的のメタデータの一部を渡すことが可能になった。 • assistant_idをメタデータではなく設定から取得するように修正された。 • これにより、langgraphの機能が向上し、柔軟な設定が可能になった。

This post explores how Amazon SageMaker HyperPod provides a comprehensive solution for inference workloads. We walk you through the platform’s key capabilities for dynamic scaling, simplified deployment, and intelligent resource management. By the end of this post, you’ll understand how to use the HyperPod automated infrastructure, cost optimization features, and performance enhancements to reduce your total cost of ownership by up to 40% while accelerating your generative AI deployments from concept to production.

In this post, we walk through how Guidesly built Jack AI on AWS using AWS Lambda, AWS Step Functions, Amazon Simple Storage Service (Amazon S3), Amazon Relational Database Service (Amazon RDS), Amazon SageMaker AI, and Amazon Bedrock to ingest trip media, enrich it with context, apply computer vision and generative AI, and publish marketing-ready content across multiple channels—securely, reliably, and at scale.

Skills in Chrome let you discover, save and remix AI workflows — and repeat them instantly.

We were able to create a JavaScript runtime just in two weeks. Without Codex, it would have taken us easily one year." Syrus Akbary Nieto, founder and CEO of Wasmer has been stress testing Codex, assigning complex, long running tasks. "We are actually moving out of the IDE itself. We're not touching as much the code, we're just guiding it where we want it to go." #shotsvideo #codex #openaicodex Learn more: https://openai.com/codex/

"We were able to create a JavaScript runtime just in two weeks. Without Codex, it would have taken us easily one year." Syrus Akbary Nieto, founder and CEO of Wasmer has been stress testing Codex, assigning complex, long running tasks. 🚀 It's been a game changer. "We are actually moving out of the IDE itself. We're not touching as much the code, we're just guiding it where we want it to go." Learn more: https://openai.com/codex/

With the new Spring AI AgentCore SDK, you can build production-ready AI agents and run them on the highly scalable AgentCore Runtime. The Spring AI AgentCore SDK is an open source library that brings Amazon Bedrock AgentCore capabilities into Spring AI. In this post, we build an AI agent starting with a chat endpoint, then adding streaming responses, conversation memory, and tools for web browsing and code execution.

この記事では、AIが生成した合成ニューロンの形状を用いて、脳のマッピングを迅速化する手法について説明しています。Google Researchの研究者たちは、合成ニューロンを利用してニューロンの分類精度を向上させ、脳の再構築を加速させることを目指しています。特に、果実バエの脳の完全なマップが作成され、166,000のニューロンが含まれていますが、哺乳類や人間の脳の完全な再構築はまだ遠い目標です。新しい論文「MoGen: Detailed neuronal morphology generation via point cloud flow matching」では、合成ニューロンを用いることで再構築誤差を4.4%削減できることが示されており、これはマウスの脳全体において157人年の手動校正を節約することに相当します。 • AIが生成した合成ニューロンを用いて脳のマッピングを迅速化する手法を提案 • 果実バエの脳マップは166,000のニューロンを含み、AIと人間の専門家による共同作業で作成された • 合成ニューロンを用いることで再構築誤差を4.4%削減できることが示された • この誤差削減は、マウスの脳全体で157人年の手動校正を節約することに相当する • Connectomicsの分野で、脳細胞の再構築を行い、脳の配線マップを作成するプロセスを加速させるためにAIを活用している

Google is bringing people together in Washington D.C. at our AI for the Economy Forum.

Over the next several weeks, we'll release lessons on AI evals.

OpenAI expands its Trusted Access for Cyber program, introducing GPT-5.4-Cyber to vetted defenders and strengthening safeguards as AI cybersecurity capabilities advance.

RooCodeIncのGitHubリポジトリで、バージョン3.52.1がリリースされたことが発表されました。このリリースは2022年4月13日に行われ、リリースノートには新機能や修正点が含まれている可能性がありますが、具体的な内容は記載されていません。リリースに関連するアセットも提供されていますが、詳細は不明です。ユーザーはGitHubのインターフェースを通じて、リリースの通知設定を変更する必要があります。 • RooCodeIncのリポジトリでバージョン3.52.1がリリースされた。 • リリース日は2022年4月13日。 • リリースノートには新機能や修正点が含まれる可能性があるが、具体的な内容は記載されていない。 • リリースに関連するアセットが提供されているが、詳細は不明。 • ユーザーはGitHubで通知設定を変更する必要がある。